はじめに

最終更新: 2026-04-02

このドキュメントは、STARK Ballot Simulator の公開向けガイドです。

目的

- システムの全体像を短時間で把握できるようにする

- 暗号プロトコルと検証パイプラインの設計根拠を説明する

- 検証手順を再現できる情報を提供する

想定読者

- 暗号検証・監査に関心のある技術者

- 本アプリケーションに興味のある技術者

本書の読み方

- まず 全体像 でシステムの概要を掴む

- 暗号プロトコル でコミットメント・Merkle ツリー等の基盤を理解する

- zkVM 設計 でゲストプログラムと証明生成の仕組みを学ぶ

- 検証パイプライン で 4 段階検証モデルの全体を把握する

- 改ざんシナリオ で教育的シミュレーションの動作を確認する

- AWS アーキテクチャ で非同期証明インフラを理解する

- API リファレンス でエンドポイント仕様を参照する

- 実際に検証する場合は 第三者検証ガイド で

bundle.zipを使ったローカル検証手順を実行する - 設計上の判断については 設計判断 を参照する

- 設計根拠の一次資料は 参考文献 を参照する

全体像

STARK Ballot Simulator は、投票の完全性を段階的に検証するための PoC です。

flowchart LR A[Cast-as-Intended] --> B[Recorded-as-Cast] B --> C[Counted-as-Recorded] C --> D[STARK Verification]

データフロー概観

sequenceDiagram participant V as 投票者 participant S as サーバー participant B as 掲示板 participant Z as zkVM participant VS as 検証サービス V->>S: 投票意図(選択肢・乱数)+ コミットメント S->>B: 掲示板に追記 S-->>V: 投票レシート Note over S: ボット投票を自動追加 S->>Z: 全投票 + Merkle パス Z-->>S: STARK レシート + ジャーナル S->>VS: STARK レシート検証 VS-->>S: 検証レポート S-->>V: 検証結果

コアコンセプト

- 投票コミットメントと投票レシートにより Cast-as-Intended を検証

- RFC 6962 / CT スタイルの掲示板で Recorded-as-Cast を検証

- zkVM ジャーナル、入力整合、ビットマップ証明により Counted-as-Recorded を検証

- RISC Zero レシート検証で STARK 実行の正当性を検証

- AWS クラウド費用の目標月額を 1 USD(デプロイなし、アプリのアクセスなし時)

プロジェクト規模

概算(tracked files ベース、生成物を除く)。

| 区分 | 行数 |

|---|---|

| TypeScript / React(アプリ本体) | 約 53,000 行 |

| TypeScript(テストコード) | 約 55,000 行 |

| Rust(zkVM ゲスト + ホスト + 検証サービス) | 約 5,000 行 |

| Terraform / Shell / 補助スクリプト | 約 8,000 行 |

| 合計 | 約 121,000 行 |

各章への案内

| 部 | 内容 |

|---|---|

| 暗号プロトコル | コミットメント、CT Merkle、入力コミットメント、STH ダイジェスト、ビットマップ Merkle |

| zkVM 設計 | ゲストプログラム、ホスト・証明生成、検証サービス、Image ID |

| 検証パイプライン | 4 段階モデル、チェック一覧、バンドル構造、ゲーティングロジック |

| 改ざんシナリオ | S0〜S5 シナリオ、検出メカニズム |

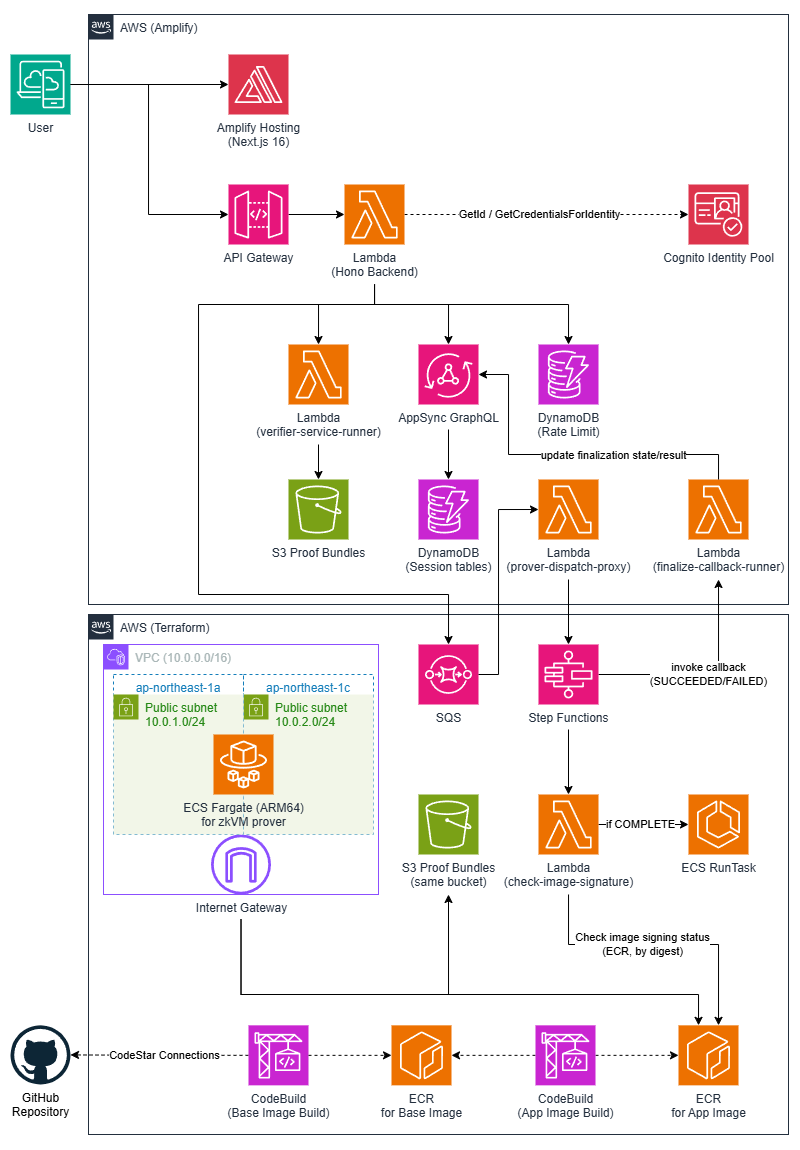

| AWS アーキテクチャ | トポロジー、非同期プローバー、イメージ署名、Terraform |

| API リファレンス | エンドポイント一覧、セッションライフサイクル |

| 第三者検証ガイド | 検証ページで取得した bundle.zip を使う Ubuntu 向けローカル検証手順 |

| 設計判断 | PoC の意図的な制約、設計ふりかえり |

暗号プロトコル

STARK Ballot Simulator で使用する暗号プリミティブとプロトコルの設計を解説します。

公開データに対する投票の秘匿性(hiding)と束縛性(binding)を支えるコミットメントスキームから、RFC 6962 に基づく CT スタイルの Merkle ツリー、zkVM 入力の正準エンコーディングまで、検証可能性の基盤となる暗号構成要素を網羅します。

この部に含まれる章

- コミットメントスキーム — 投票コミットメントの構成と安全性

- CT Merkle ツリー — CT スタイルの追記専用掲示板

- 入力コミットメント — zkVM 入力の正準エンコーディング

- STH ダイジェスト — 分割ビュー緩和のためのツリーヘッドダイジェスト

- ビットマップ Merkle — 投票カウント証明のためのビットマップツリー

コミットメントスキーム

投票者の選択を公開データから秘匿しつつ束縛するコミットメントスキームの設計を解説します。

SHA-256 ベースのコミットメントにより、投票内容の hiding(秘匿性)と binding(束縛性)を実現します。ドメイン分離タグにより、他プロトコルとのコミットメント衝突を防止します。

概要

投票コミットメントは、投票者が選んだ選択肢を公開データからは隠したまま、その選択に束縛されることを可能にする暗号プリミティブです。投票時にはコミットメント値のみが掲示板に記録され、選択肢と乱数は掲示板や public-input.json を含む配布対象バンドルには現れません。投票者は Cast-as-Intended 検証のためにこれらをローカルに保持します。

ただし、本 PoC は operator に対する完全な秘匿性を目的としていません。現行実装ではクライアントから投票 API に opening(選択肢と乱数)も送信され、サーバー側ストアに保持されうるため、ここでいう hiding は主に公開観測者や公開配布物に対する性質を指します。

flowchart LR

subgraph 入力

E[選挙 ID<br/>16 バイト UUID]

C[選択肢<br/>1 バイト]

R[乱数<br/>32 バイト]

end

E --> H[SHA-256]

C --> H

R --> H

T["ドメインタグ<br/>"stark-ballot:commit|v1.0""] --> H

H --> CM[コミットメント<br/>32 バイト]

コミットメントの正準フォーマット

コミットメント値は、以下の入力を連結し SHA-256 で圧縮して生成されます。

commitment = SHA-256(

domain_tag || ← "stark-ballot:commit|v1.0" (24 バイト, UTF-8)

election_id || ← UUID v4 のバイナリ表現 (16 バイト)

choice || ← 選択肢の値 (1 バイト, 0〜4)

random ← 一様乱数 (32 バイト)

)

各フィールドの仕様

| フィールド | サイズ | エンコーディング | 説明 |

|---|---|---|---|

| ドメインタグ | 24 バイト | UTF-8 固定文字列 | "stark-ballot:commit|v1.0" |

| 選挙 ID | 16 バイト | UUID v4 からハイフンを除去し、16 進数をバイト列に変換 | 選挙スコープの識別子 |

| 選択肢 | 1 バイト | 符号なし整数 (0 = A, 1 = B, 2 = C, 3 = D, 4 = E) | 投票者の選択 |

| 乱数 | 32 バイト | 暗号学的に安全な一様乱数 | hiding 性を保証 |

SHA-256 への入力は合計 73 バイト、出力は 32 バイト(16 進数表記で 64 文字、0x プレフィックス付きでは 66 文字)です。

ドメイン分離

ドメインタグ "stark-ballot:commit|v1.0" は、このコミットメントが他のプロトコルで使用されるハッシュ値と偶発的に衝突することを防ぐための仕組みです。

ドメイン分離は本システムの全暗号プリミティブに一貫して適用されています。

| プリミティブ | ドメインタグ |

|---|---|

| コミットメント | "stark-ballot:commit|v1.0" |

| 入力コミットメント | "stark-ballot:input|v1.0" |

| Merkle リーフ | 0x00 || "stark-ballot:leaf|v1" |

| Merkle ノード | 0x01 |

| ログ ID | "stark-ballot:bulletin-log|v1.0" |

安全性

Hiding(秘匿性)

乱数フィールドが 32 バイト(256 ビット)のエントロピーを持つため、公開されたコミットメント値から選択肢を推測することは計算量的に不可能です。

前提条件:

- 乱数は暗号学的に安全な乱数生成器(CSPRNG)から生成される

- 同じ乱数は決して再利用しない

乱数の再利用は hiding 性を破壊します。同一選挙で同一乱数を使用した場合、同じ選択肢であればコミットメント値が一致してしまい、情報が漏洩します。

Binding(束縛性)

SHA-256 の原像耐性(preimage resistance)と第二原像耐性(second-preimage resistance)により、一度コミットした値と異なる選択肢に対して同じコミットメント値を生成することは計算量的に不可能です。

つまり、投票者はコミットメント公開後に「別の選択肢に投票した」と主張を変えることができません。

TypeScript と Rust の実装同期

コミットメントは TypeScript(クライアント・サーバー)と Rust(zkVM ゲスト)の双方で計算されます。これら 2 つの実装は、バイトレベルで完全に同一の出力を生成する必要があります。

同期が必要な要素:

- ドメインタグの文字列とエンコーディング(UTF-8)

- UUID からバイト列への変換規則(ハイフン除去 → 16 進数デコード)

- 選択肢の整数エンコーディング(1 バイト、符号なし)

- 乱数の 16 進数デコード規則

ドメインタグやエンコーディング規則を変更する場合は、TypeScript と Rust の両実装を同時に更新する必要があります。どちらか一方のみの変更は、コミットメント照合の失敗を引き起こします。

検証パイプラインにおける役割

コミットメントは、4 段階検証モデルの最初の 3 段階で中心的な役割を果たします。

| 検証段階 | コミットメントの役割 |

|---|---|

| Cast-as-Intended | 投票者がローカルに保持する(選択肢, 乱数, 選挙 ID)からコミットメントを再計算し、投票レシートと照合する |

| Recorded-as-Cast | 掲示板上でコミットメントの包含証明を検証し、投票時点のツリー状態に対して正しく記録されたことを確認する |

| Counted-as-Recorded | zkVM ゲストが prover から渡された各 vote opening でコミットメントを再計算し、掲示板上の値と整合する票だけを tally に含める |

注意: Counted-as-Recorded は投票者ローカルの opening ではなく、prover に渡された opening を使います。Cast-as-Intended とは照合対象の出所が異なる点に注意してください。

現行実装の Recorded-as-Cast では、投票時点(cast-time)のツリー状態に対する包含証明を使います。投票時に投票時ルート(内部名 rootAtCast)を保存し、後続の証明取得や最終化では投票時点のツリーサイズ(bulletinIndex + 1)に対する包含証明を再導出します。保存済みの投票時ルートと再導出した証明のルートが一致しない場合、その票の公開証拠は fail-closed で拒否されます。一致した場合にのみ、レシートの bulletinRootAtCast として公開されます。

各チェックの判定ロジックは チェック一覧 > Cast-as-Intended を参照してください。

sequenceDiagram

participant V as 投票者

participant S as サーバー

participant B as 掲示板

participant Z as zkVM

V->>V: (選択肢, 乱数) を選び<br/>コミットメントを計算

V->>S: コミットメント, 選択肢, 乱数を送信

S->>S: opening から<br/>コミットメントを再計算して照合

S->>B: コミットメントを掲示板に追記

S-->>V: 投票レシート(インデックス,<br/>bulletinRootAtCast)

Note over V: ローカルに (選択肢, 乱数) を保存

Note over Z: ゲストプログラムが<br/>コミットメントを再計算し<br/>掲示板の値と照合

CT Merkle ツリー

RFC 6962(Certificate Transparency)を参照した CT スタイルの追記専用 Merkle ツリーの設計を解説します。

リーフハッシュ(0x00 プレフィックス)とノードハッシュ(0x01 プレフィックス)の区別により、second-preimage 攻撃を防止します。包含証明と整合性証明により、投票の記録と掲示板の追記専用性を検証可能にします。

なぜ RFC 6962 CT スタイルか

- 整合性証明で追記専用性を示せるため、Recorded-as-Cast に必要な「後から削除・改変されていない」保証を与えられる。

- 包含証明と整合性証明の両方を同一モデルで扱える。

- STH ダイジェストと組み合わせてスプリットビュー攻撃の検出力を上げられる。

概要

本システムの掲示板(Bulletin Board)は、Certificate Transparency (CT) で実績のある追記専用ログの設計を投票に応用しています。各投票コミットメントは Merkle ツリーのリーフとして追記され、一度記録されたエントリは削除も改変もできません。

graph TD

subgraph "8 リーフのツリー(N=8)"

R["ルート<br/>SHA-256(0x01 || L || R)"]

N1["ノード"]

N2["ノード"]

N3["ノード"]

N4["ノード"]

N5["ノード"]

N6["ノード"]

L0["リーフ 0"]

L1["リーフ 1"]

L2["リーフ 2"]

L3["リーフ 3"]

L4["リーフ 4"]

L5["リーフ 5"]

L6["リーフ 6"]

L7["リーフ 7"]

R --> N1

R --> N2

N1 --> N3

N1 --> N4

N2 --> N5

N2 --> N6

N3 --> L0

N3 --> L1

N4 --> L2

N4 --> L3

N5 --> L4

N5 --> L5

N6 --> L6

N6 --> L7

end

RFC 6962 参照ハッシュ規則

RFC 6962 Section 2 に従い、リーフノードと内部ノードに異なるドメイン分離プレフィックスを適用します。

リーフハッシュ

LeafHash = SHA-256(0x00 || "stark-ballot:leaf|v1" || leaf_data)

| 要素 | サイズ | 説明 |

|---|---|---|

| プレフィックス | 1 バイト | 0x00(リーフ識別子) |

| 使用タグ | 20 バイト | "stark-ballot:leaf|v1"(UTF-8) |

| リーフデータ | 可変 | コミットメント hex をデコードした生バイト列(32 バイト) |

内部ノードハッシュ

NodeHash = SHA-256(0x01 || left_hash || right_hash)

| 要素 | サイズ | 説明 |

|---|---|---|

| プレフィックス | 1 バイト | 0x01(内部ノード識別子) |

| 左子ハッシュ | 32 バイト | 左部分木のハッシュ |

| 右子ハッシュ | 32 バイト | 右部分木のハッシュ |

ドメイン分離の安全性

0x00(リーフ)と 0x01(内部ノード)のプレフィックス区別は、second-preimage 攻撃を防止するために不可欠です。この区別がなければ、攻撃者はリーフノードを内部ノードとして解釈させる(またはその逆の)偽造データを構築できる可能性があります。

使用タグ "stark-ballot:leaf|v1" は、他システムのリーフハッシュとの偶発的な衝突を防止する追加の防御層です。

Merkle Tree Hash(MTH)アルゴリズム

RFC 6962 で定義される MTH アルゴリズムは、任意のサイズのデータセットからルートハッシュを計算します。

アルゴリズムの定義

- 空のツリー:

MTH({}) = SHA-256()(空入力のハッシュ) - 単一リーフ:

MTH({d₀}) = LeafHash(d₀) - 複数リーフ: サイズ n のツリーに対し、k を n 未満の最大の 2 のべき乗とする

MTH({d₀, ..., dₙ₋₁}) = SHA-256(0x01 || MTH({d₀, ..., dₖ₋₁}) || MTH({dₖ, ..., dₙ₋₁}))

非 2 のべき乗サイズへの対応

ツリーサイズが 2 のべき乗でない場合(例: 5, 6, 7 リーフ)、MTH アルゴリズムは「n 未満の最大の 2 のべき乗」で分割を行います。これにより、左部分木は常に完全二分木(2 のべき乗サイズ)となり、右部分木にのみ不完全さが集中します。

graph TD

subgraph "5 リーフのツリー(k=4 で分割)"

Root["ルート"]

Left["左部分木<br/>MTH(d₀..d₃)<br/>完全二分木"]

Right["右部分木<br/>MTH(d₄)<br/>単一リーフ"]

Root --> Left

Root --> Right

end

デフォルトのデモ構成では 64 票(2⁶)を扱うため、最終的なツリーは完全二分木になります。ただし、実装は任意の treeSize を扱う前提であり、投票の追加途中や小規模な検証ケースでは非 2 のべき乗サイズのツリーが出現するため、MTH アルゴリズムの一般的な対応が必要です。

掲示板のリーフデータ形式

掲示板に追記される各投票のリーフデータは、コミットメントの正規化された 16 進数表現(0x なし、小文字、64 文字)を 32 バイトにデコードした生バイト列です。

leaf_data = hex_decode(normalized_commitment_hex) (32 バイト)

掲示板は以下の不変条件を維持します:

- 単調増加インデックス: 各投票に 0 から始まる連番が割り当てられる

- 重複排除: 同一の投票 ID やコミットメントの二重追記を拒否する

- ルート履歴: 各追記時点のルートハッシュをタイムスタンプとともに保存する

包含証明(Inclusion Proof)

包含証明は、特定のコミットメントがツリーの特定位置に含まれていることを、ルートハッシュに対して暗号学的に証明するものです。

構造

包含証明は以下の要素で構成されます:

| フィールド | 説明 |

|---|---|

| leafIndex | リーフの 0 始まりインデックス |

| proofNodes | 兄弟ハッシュの配列(監査パス) |

| treeSize | 証明時点のツリーサイズ |

| rootHash | 検証対象のルートハッシュ |

実装での名称: 本章では RFC 6962 の抽象名を使いますが、API では異なるフィールド名で返します。

抽象名 API フィールド名 proofNodesmerklePathrootHashbulletinRootAtCast

/api/verifyのuserVote.proofや/api/bulletin/:voteId/proofがこの構造に対応します。

PATH アルゴリズム

RFC 6962 の PATH 関数に従い、監査パスを再帰的に生成します。

- ツリーをサイズ k(n 未満の最大の 2 のべき乗)で左右に分割

- 対象リーフが左部分木にある場合(

index < k):- 左部分木の PATH を再帰計算

- 右部分木のハッシュを監査パスに追加

- 対象リーフが右部分木にある場合(

index >= k):- 右部分木の PATH を再帰計算(インデックスを

index - kに調整) - 左部分木のハッシュを監査パスに追加

- 右部分木の PATH を再帰計算(インデックスを

検証手順

検証者は以下の手順で包含を確認します:

- コミットメントのリーフハッシュを計算:

LeafHash(commitment) - PATH アルゴリズムと同じ木構造に従い、監査パスのノードを順に結合

- 計算されたルートが期待するルートハッシュと一致するか確認

Recorded-as-Cast では、包含証明に加えて以下の cast-time 一貫性も確認します:

leafIndexがレシートのbulletinIndexと一致することtreeSizeがbulletinIndex + 1と一致すること(投票時点のツリーサイズ)

監査パスのサイズは O(log n) であり、64 票のツリーでは最大 6 ノードです。

graph TD

subgraph "インデックス 5 の包含証明"

Root["ルート ✓"]

N1["H(N3, N4)"]

N2["H(N5, N6) ← 計算対象"]

N3["H(L0,L1)<br/>監査パス"]

N4["H(L2,L3)<br/>監査パス"]

N5["H(L4,L5) ← 計算対象"]

N6["H(L6,L7)<br/>監査パス"]

L4["L4<br/>監査パス"]

L5["L5 ← 対象リーフ"]

Root --> N1

Root --> N2

N1 --> N3

N1 --> N4

N2 --> N5

N2 --> N6

N5 --> L4

N5 --> L5

end

style L5 fill:#4CAF50,color:#fff

style N3 fill:#2196F3,color:#fff

style N4 fill:#2196F3,color:#fff

style N6 fill:#2196F3,color:#fff

style L4 fill:#2196F3,color:#fff

整合性証明(Consistency Proof)

整合性証明は、古いツリー状態(サイズ m)が新しいツリー状態(サイズ n)の前方互換的なプレフィックスであること、つまり追記専用性を暗号学的に証明するものです。

構造

| フィールド | 説明 |

|---|---|

| oldSize | 古いツリーのサイズ(m) |

| newSize | 新しいツリーのサイズ(n) |

| proofNodes | 整合性を証明するハッシュの配列 |

補足:

/api/bulletin/consistency-proofはproofNodesに加えてrootAtOldSizeとrootAtNewSizeも返します。Recorded-as-Cast の評価では、これらがレシートのbulletinRootAtCastと最終bulletinRootに一致することも確認します。

SUBPROOF アルゴリズム

RFC 6962 の SUBPROOF 関数に基づき、整合性証明を再帰的に生成します。

m = nかつ古いツリーが完全部分木: 空の証明を返すm = nかつ完全部分木でない: 部分木のルートハッシュを返す- k を n 未満の最大の 2 のべき乗とし:

m <= kの場合: 左部分木の SUBPROOF + 右部分木のハッシュm > kの場合: 右部分木の SUBPROOF + 左部分木のハッシュ

検証の意味

整合性証明の検証が成功することは、以下を意味します:

- 古いツリーのすべてのリーフが、新しいツリーにも同じ位置・同じ値で存在する

- 新しいツリーは古いツリーの末尾にリーフを追加しただけで構成されている

- 古いツリーのルートハッシュと新しいツリーのルートハッシュの両方が、提供された証明ノードから独立に再構成できる

これにより、サーバーが過去に記録した投票を密かに削除したり順序を変更したりする攻撃を検出できます。

検証パイプラインにおける役割

CT Merkle ツリーは、4 段階検証モデルの主に 2 段階で使用されます。

| 検証段階 | CT Merkle の役割 |

|---|---|

| Recorded-as-Cast | 包含証明でコミットメントの記録を確認し、整合性証明で追記専用性を確認する |

| Counted-as-Recorded | zkVM ゲストが同じハッシュ規則で各 vote の包含を内部検証する |

ユーザー向けの Recorded-as-Cast では、recorded_inclusion_proof が包含証明を、recorded_consistency_proof が追記専用性を担当し、他の派生チェックもこれらの結果に基づきます。zkVM ゲストも同じハッシュ規則で各 vote の包含を内部検証するため、規則の不一致はゲスト内での検証失敗として即座に検出されます。

各チェックの判定ロジックは チェック一覧 > Recorded-as-Cast を参照してください。

RFC 6962 参照範囲

| 要件 | 対応状況 | 備考 |

|---|---|---|

| リーフ・ノードのドメイン分離 | 実装済 | 0x00 / 0x01 プレフィックス |

| MTH アルゴリズム | 実装済 | 再帰的分割 + キャッシュ最適化 |

| PATH 関数(包含証明) | 実装済 | O(log n) サイズの監査パス |

| SUBPROOF 関数(整合性証明) | 実装済 | 再帰的生成 + 1→2 特殊ケース対応 |

| 非 2 のべき乗サイズ | 実装済 | 最大 2 のべき乗分割 |

| 証明の独立検証 | 実装済 | ツリーの完全な再構築なしに検証可能 |

本システムはリーフハッシュに使用タグ "stark-ballot:leaf|v1" を追加しています。これは RFC 6962 の拡張であり、他システムとのリーフハッシュ衝突を防止するための措置です。標準の CT 実装との直接的な相互運用は意図していません。

入力コミットメント

zkVM 入力の公開可能フィールドに対する正準エンコーディングとコミットメントの設計を解説します。

入力コミットメントが束縛するのは zkVM 入力全体ではなく、現行実装で公開検証に使うフィールド群です。

入力コミットメントにより、「証明されたデータセット」と「主張されたデータセット」の一致を検証可能にします。バイトレベルの正準化により、TypeScript と Rust の間で決定的な一致を保証します。

概要

入力コミットメントは、zkVM 入力のうち現行実装で束縛する公開可能な検証フィールドを単一のハッシュ値に集約するプロトコルです。可変部分として electionId、bulletinRoot、treeSize、totalExpected、votesCount と、各投票の index・コミットメント値・Merkle パスを含みます。厳密な計算では、これに固定のドメインタグ stark-ballot:input|v1.0 と version 10(v1.0)も加わります。

このハッシュ値は zkVM のジャーナル(公開出力)にコミットされるため、第三者はジャーナルに記録された入力コミットメントと、public-input.json などの公開可能な検証データから再計算した値を照合することで、zkVM が実際にどのデータセットを処理したかを独立に検証できます。

flowchart TB IN["入力データ<br/>electionId / bulletinRoot / treeSize<br/>/ totalExpected / votes (index 昇順)"] SPEC["固定値<br/>domainTag: stark-ballot:input|v1.0<br/>version: 10"] IN --> ENC[正準エンコーディング] SPEC --> ENC ENC --> H[SHA-256] H --> IC[入力コミットメント<br/>32 バイト] IC --> CMP["第三者照合<br/>再計算値 = journal.inputCommitment"]

入力コミットメントが解決する問題

zkVM の STARK 証明は「ゲストプログラムが正しく実行された」ことを証明しますが、「どの入力に対して実行されたか」は証明のスコープ外です。入力コミットメントがなければ、悪意あるサーバーは以下の攻撃が可能になります:

- 投票を除外した入力で zkVM を実行し、有効な STARK 証明を取得する

- 公開用の入力データには除外されていない投票を含めて提示する

- 第三者は STARK 証明が有効であることを確認できるが、実際に処理された入力は異なる

入力コミットメントをジャーナルに含めることで、第三者は「公開データから再計算した入力コミットメント」と「ジャーナルに記録された入力コミットメント」を照合し、不一致を検出できます。

正準エンコーディング

入力コミットメントの計算には、すべてのフィールドを決定的な順序・エンコーディングで連結する正準化が不可欠です。

バイトレイアウト

input_commitment = SHA-256(

domain_tag ← "stark-ballot:input|v1.0" (23 バイト, UTF-8)

|| version ← u32 リトルエンディアン (4 バイト) = 10

|| election_id ← UUID v4 バイナリ (16 バイト)

|| bulletin_root ← 32 バイト

|| tree_size ← u32 リトルエンディアン (4 バイト)

|| total_expected← u32 リトルエンディアン (4 バイト)

|| votes_count ← u32 リトルエンディアン (4 バイト)

|| [投票データ] ← インデックス昇順でソートされた各投票

)

各投票のエンコーディング

投票配列の各要素は以下の形式でエンコードされます:

vote_entry =

index ← u32 リトルエンディアン (4 バイト)

|| commitment_len← u16 リトルエンディアン (2 バイト) = 32 (固定)

|| commitment ← 32 バイト

|| path_len ← u16 リトルエンディアン (2 バイト)

|| path_nodes ← path_len × 32 バイト

フィールド一覧

| フィールド | サイズ | エンコーディング | 説明 |

|---|---|---|---|

| ドメインタグ | 23 バイト | UTF-8 固定文字列 | "stark-ballot:input|v1.0" |

| バージョン | 4 バイト | u32 LE | v1.0 = 10 |

| 選挙 ID | 16 バイト | UUID バイナリ | 選挙スコープの識別子 |

| 掲示板ルート | 32 バイト | ハッシュ値 | 最終的な Merkle ルート |

| ツリーサイズ | 4 バイト | u32 LE | 掲示板のリーフ数 |

| 期待投票数 | 4 バイト | u32 LE | 想定される総投票数 |

| 投票数 | 4 バイト | u32 LE | 実際に含まれる投票数 |

| 各投票インデックス | 4 バイト | u32 LE | 掲示板上の位置 |

| コミットメント長 | 2 バイト | u16 LE | 固定値 32 |

| コミットメント | 32 バイト | ハッシュ値 | 投票コミットメント |

| パス長 | 2 バイト | u16 LE | Merkle パスのノード数 |

| パスノード | 各 32 バイト | ハッシュ値 | 包含証明の兄弟ハッシュ |

public-input.json と公開監査アーティファクトとの関係

public-input.json は、zkVM 検証に使う秘密データを含まない検証用レコードです。現行実装では schema、version、electionId、electionConfigHash、bulletinRoot、treeSize、totalExpected、logId、timestamp、methodVersion と、各投票の index・コミットメント値・Merkle パスを含みます。

ただし、public-input.json に含まれる全フィールドが入力コミットメントの計算対象に入るわけではありません。現行実装で直接束縛されるのは、概要で示した対象フィールドに固定のドメインタグと version を加えた部分です。electionConfigHash、logId、timestamp、methodVersion は入力コミットメントには直接含まれません。

現行実装では、公開パラメータの照合は public-input.json 単体では完結せず、proof bundle に含まれる election-manifest.json と close-statement.json も組み合わせて検証されます。入力コミットメント対象外のフィールドは、次のように別経路で照合されます。

electionConfigHash→counted_election_manifest_consistent(manifest と journal 等を照合)logId・timestamp→counted_close_statement_consistent(close statement と journal 等を照合)methodVersion→ 入力コミットメントには含まれない。journal 互換性チェックや Image ID 解決に使用

したがって、counted_input_commitment_match は公開パラメータ照合の中核ですが、唯一のクロスチェックではありません。残りのパラメータは上記チェックで補完的に検証されます。

正準化規則

エンコーディングの決定性を保証するために、以下の規則が厳守されます。

ソート規則

投票はインデックスの昇順にソートしてからエンコードする必要があります。

入力データの投票順序は任意であり得ますが、エンコーディング前にインデックスでソートすることで、同じ投票集合から常に同一のバイト列が生成されます。この規則に違反すると、TypeScript と Rust で異なるハッシュ値が計算され、検証が失敗します。

前提となる不変条件:

- 各投票の

indexは一意である(重複インデックスは不正入力)

重複インデックスが存在する入力はプロトコル違反であり、正常系の正準化対象ではありません。したがって、正準順序の主キーは index の昇順として定義されます。

実装上は、重複インデックスという異常入力に対して Rust 側で追加の tie-break(commitment と merklePath)を行いますが、これはあくまで異常系の決定性補助であり、正常系仕様を変更するものではありません。

エンディアン規則

すべての整数フィールドはリトルエンディアンでエンコードされます。

| 型 | バイト数 | エンコーディング |

|---|---|---|

| u16 | 2 | リトルエンディアン |

| u32 | 4 | リトルエンディアン |

16 進数正規化

コミットメント値やパスノードなどの 16 進数表現は、0x プレフィックスを除去した上でバイト列にデコードされます。16 進数文字列のまま連結するのではなく、常にバイナリ表現を使用します。

TypeScript と Rust の同期

入力コミットメントは TypeScript(サーバー側)と Rust(zkVM ゲスト内)の双方で独立に計算され、結果が一致する必要があります。

flowchart LR

subgraph TypeScript

TS_IN[public-input.json から抽出した<br/>入力コミットメント対象フィールド] --> TS_CALC[正準エンコーディング<br/>+ SHA-256]

TS_CALC --> TS_IC[入力コミットメント A]

end

subgraph "Rust (zkVM ゲスト)"

RS_IN[ゲスト入力] --> RS_CALC[正準エンコーディング<br/>+ SHA-256]

RS_CALC --> RS_IC[入力コミットメント B]

end

TS_IC --> CMP{A = B ?}

RS_IC --> CMP

CMP -->|一致| OK[検証成功]

CMP -->|不一致| NG[検証失敗:<br/>入力データが異なる]

同期が破壊される典型的な原因:

- ソート順序の不一致

- エンディアンの不一致

- ドメインタグの文字列差異

- バージョン番号の不一致

- 16 進数正規化規則の差異(大文字/小文字、

0xプレフィックスの有無)

検証パイプラインにおける役割

入力コミットメントは、Counted-as-Recorded 段階での検証チェック counted_input_commitment_match として使用されます。

現行の Counted-as-Recorded 段階では、これに加えて counted_election_manifest_consistent と counted_close_statement_consistent も必須チェックとして動作します(対象フィールドと対応関係は上記を参照)。

| チェック ID | 検証内容 |

|---|---|

counted_input_commitment_match | 公開可能な検証データから再計算した入力コミットメントがジャーナルの値と一致するか |

このチェックが失敗する場合、zkVM が処理した入力データと公開可能な検証データから再構成される入力コミットメント対象フィールドが異なることを意味し、結果の信頼性が根本的に損なわれます。

各チェックの判定ロジックは チェック一覧 > Counted-as-Recorded を参照してください。

注意事項

入力コミットメントには投票者の秘密データ(選択肢や乱数)は含まれません。束縛対象は概要で示した公開可能なフィールドのみであるため、入力コミットメントの公開は投票の秘密性を損ないません。

STH ダイジェスト

Signed Tree Head (STH) ダイジェストによる分割ビュー攻撃の緩和メカニズムを解説します。

ログ ID、ツリーサイズ、タイムスタンプ、掲示板ルートを束縛するダイジェストにより、サーバーが異なるクライアントに異なるツリー状態を提示する攻撃を検出可能にします。

概要

分割ビュー攻撃(split-view attack)とは、悪意あるサーバーが異なる検証者に対して異なる掲示板の状態を提示する攻撃です。例えば、投票者 A には「全 64 票が含まれたツリー」を見せながら、投票者 B には「特定の票が除外されたツリー」を見せることが考えられます。

STH ダイジェストは、掲示板の状態を(ログ ID、ツリーサイズ、タイムスタンプ、ルートハッシュ)の組として束縛し、独立した第三者ソースとの合意確認を通じてこの攻撃を検出します。

flowchart TD

subgraph "STH ダイジェストの構成"

LID[ログ ID<br/>32 バイト]

TSZ[ツリーサイズ<br/>4 バイト]

TS[タイムスタンプ<br/>8 バイト]

BR[掲示板ルート<br/>32 バイト]

end

LID --> H[SHA-256]

TSZ --> H

TS --> H

BR --> H

H --> STH[STH ダイジェスト<br/>32 バイト]

STH --> J[zkVM ジャーナルに記録]

STH --> CS[close-statement.json に記録]

STH --> TP[第三者ソースの STH と照合]

ダイジェストフォーマット

sth_digest = SHA-256(

log_id ← 32 バイト

|| tree_size ← u32 リトルエンディアン (4 バイト)

|| timestamp ← u64 リトルエンディアン (8 バイト, Unix 時刻ミリ秒)

|| bulletin_root ← 32 バイト

)

SHA-256 への入力は合計 76 バイトです。

各フィールドの仕様

| フィールド | サイズ | エンコーディング | 説明 |

|---|---|---|---|

| ログ ID | 32 バイト | ハッシュ値 | 掲示板インスタンスの識別子 |

| ツリーサイズ | 4 バイト | u32 LE | 掲示板のリーフ数 |

| タイムスタンプ | 8 バイト | u64 LE | Unix 時刻(ミリ秒) |

| 掲示板ルート | 32 バイト | ハッシュ値 | Merkle ツリーのルート |

ログ ID

ログ ID は掲示板インスタンスを一意に識別するための値であり、以下のように生成されます:

log_id = SHA-256("stark-ballot:bulletin-log|v1.0" || seed)

ドメインタグ "stark-ballot:bulletin-log|v1.0" と任意のシード値を連結し、SHA-256 でハッシュします。ログ ID は掲示板のライフタイム中に変化しない固定値です。

ログ ID を STH ダイジェストに含めることで、異なる掲示板インスタンスの STH が偶然に衝突することを防止します。

分割ビュー攻撃と検出メカニズム

攻撃シナリオ

sequenceDiagram

participant A as 投票者 A

participant S as 悪意あるサーバー

participant B as 投票者 B

S->>A: ツリー状態 X<br/>(64 票、ルート R₁)

S->>B: ツリー状態 Y<br/>(63 票、ルート R₂)

Note over A,B: A と B は互いに異なる<br/>ツリー状態を見ている

この攻撃では、サーバーは投票者 B に対して特定の票を除外したツリーを見せています。投票者 B は自身に提示されたツリーに対する包含証明や整合性証明を検証できますが、投票者 A とは異なるツリーを見ていることに気づけません。

第三者合意による検出

検証者は、NEXT_PUBLIC_STH_SOURCES に設定された独立ソースへ問い合わせ、ジャーナル内の STH ダイジェストと照合することで分割ビューを検出できます。

sequenceDiagram

participant V as 検証者

participant S as サーバー

participant T1 as 第三者ソース 1

participant T2 as 第三者ソース 2

V->>S: ジャーナルから STH ダイジェスト D' を取得

V->>T1: STH を問い合わせ → D₁

V->>T2: STH を問い合わせ → D₂

V->>V: D' = D₁ = D₂ ?

alt 全て一致

V->>V: 合意成立 → 検証成功

else 不一致あり

V->>V: 分割ビューの疑い → 検証失敗

end

現行実装は第三者ソースへの照会(fetch)を行うものであり、アプリケーションが第三者ソースへ STH を自動公開する機能は含みません。

開発用に利用できる /api/sth は same-origin の session-scoped API です。アクセスにはセッション capability が必要であり、検証ロジックもそれらの認証ヘッダーを same-origin ソースにのみ転送します。cross-origin のソースへセッション認証情報を送ることはありません。

また、/api/sth が返す timestamp は現状ではジャーナル内の canonical な時刻ではなく session.lastActivity です。第三者合意の一致判定で実際に照合するのは、必須の sthDigest と、ソースが返した場合の bulletinRoot / treeSize です。

合意ロジック

第三者 STH 検証は以下の条件をすべて満たした場合に成功します:

- 十分な一致数: 一致するソースの数が最小要求数(コードフォールバック値: 2)以上

- 全会一致: 応答可能なすべてのソースが一致すること(

matchingSources = comparableSources)

各ソースに対して以下のフィールドが照合されます:

| 照合フィールド | 条件 |

|---|---|

| STH ダイジェスト | 必須一致 |

| 掲示板ルート | 提供されている場合は一致 |

| ツリーサイズ | 提供されている場合は一致 |

zkVM との連携

zkVM ゲストプログラムは、入力として受け取ったログ ID、ツリーサイズ、タイムスタンプ、掲示板ルートから STH ダイジェストを再計算し、ジャーナルにコミットします。

finalize 時には、同じツリー状態から close-statement.json も構築され、sthDigest が公開 bundle に含まれます。

この仕組みにより、STARK 証明と公開 bundle 内の close-statement.json がともに特定のツリー状態へ束縛されます。第三者はジャーナルの STH ダイジェストを独立ソースの値と照合することで、サーバーが証明と異なるツリー状態を提示していないかを確認できます。

検証パイプラインにおける役割

STH ダイジェストは 2 つの段階で利用されます。

| 段階 | チェック ID | 検証内容 |

|---|---|---|

| Recorded-as-Cast | recorded_sth_third_party | 独立ソースから取得した STH ダイジェストがジャーナルの値と一致するか |

| Counted-as-Recorded | counted_close_statement_consistent | close-statement.json の sthDigest が公開入力およびジャーナルの値と整合するか |

recorded_sth_third_party は既定では任意チェック(optional)ですが、STH ソースが設定されている場合は必須扱いへ昇格します。昇格後は、このチェックが成功以外の状態にある限り「Verified」にはなりません(failed・not_run・pending・running のほか、required チェックの欠落も同様にブロックします)。

counted_close_statement_consistent は常に必須チェック(required)です。close-statement.json がジャーナルと整合しない場合、検証は失敗します。

各チェックの判定ロジックは チェック一覧 > Recorded-as-Cast と チェック一覧 > Counted-as-Recorded を参照してください。

設定

第三者 STH 検証は環境変数で制御されます。

| 環境変数 | 説明 | コードフォールバック値 |

|---|---|---|

NEXT_PUBLIC_STH_SOURCES | カンマ区切りの STH ソース URL | 未設定(第三者照合を実行しない) |

NEXT_PUBLIC_STH_MIN_MATCHES | 必要な最小一致ソース数 | 2 |

STH ソースが未設定の場合、recorded_sth_third_party は not_run(未実行)となり、第三者照合は行いません。セキュリティ上は少なくとも 2 つ以上の独立ソースを設定することが推奨されます。

相対パス(例: /api/sth)はリクエスト元のオリジンに対して解決されます。

/api/sth のような same-origin ソースを使う場合、アプリケーションはセッション capability をそのオリジンにのみ転送します。独立第三者ソースを absolute URL で構成する場合、それらはセッション認証に依存しない公開 STH エンドポイントであることが前提です。

開発用の .env.local.example では次の値が設定されています:

NEXT_PUBLIC_STH_SOURCES=/api/sthNEXT_PUBLIC_STH_MIN_MATCHES=1

この設定は PoC の動作確認を優先したものです。独立した複数ソースと NEXT_PUBLIC_STH_MIN_MATCHES >= 2 を使用すれば、より強い保証が得られます。

PoC における制約

本 PoC の開発用テンプレート(.env.local.example)では、STH ソースとして同一サーバー上の API エンドポイント(/api/sth)を使用します。同一サーバー上のソースのみでは防御力が限定的であるため、独立した組織が運営する複数ソースの使用を推奨します。

ビットマップ Merkle

投票カウント証明のためのビットマップ Merkle ツリーの設計を解説します。

zkVM ゲスト内で計算されるビットマップにより、各投票インデックスが集計に含まれたかどうかを個別に検証可能にします。Merkle 証明により、自分の投票が含まれていることをサーバーを信頼せずに確認できます。

概要

Counted-as-Recorded 段階の検証では、「全体として正しい集計が行われた」ことは STARK 証明で保証されますが、個々の投票者にとって「自分の票が集計に含まれたか」を直接確認する手段が別途必要です。

ビットマップ Merkle ツリーは、この「個別のカウント証明」を提供します。zkVM ゲストは投票ごとの状態をビットマップとしてエンコードし、その Merkle ルートをジャーナルにコミットします。投票者は自分のインデックスに対応するビットの Merkle 証明を取得し、「自分の票がカウントされたか」「そもそも prover に提示されたか」を独立に検証できます。

flowchart TD

subgraph "zkVM ゲスト内"

BM["ビットマップ<br/>[true, true, false, true, ...]"] --> PK[ビットパッキング<br/>LSB-first]

PK --> CH[32 バイトチャンク分割]

CH --> LH["リーフハッシュ<br/>SHA-256(0x00 || tag || chunk)"]

LH --> MT[Merkle ツリー構築]

MT --> ROOT["includedBitmapRoot / seenBitmapRoot"]

end

ROOT --> JNL[ジャーナルにコミット]

ビットマップの構造

ビットマップの定義

ビットマップは、ツリーサイズ(投票数)と同じ長さのブール配列です。現行実装では同じエンコーディング規則を持つ 2 種類のビットマップを扱います。

includedBitmap[i] = true: インデックス i の投票が正常に検証され、集計に含まれたincludedBitmap[i] = false: インデックス i の投票が除外されたseenBitmap[i] = true: インデックス i の投票が prover に提示されたseenBitmap[i] = false: インデックス i の投票が prover に提示されなかった

本 PoC では 64 票を扱うため、ビットマップは 64 ビット(= 8 バイト)です。

LSB-first ビットパッキング

ブール配列は LSB-first(Least Significant Bit first)方式でバイト列にパッキングされます。

ビット配列: [b₀, b₁, b₂, b₃, b₄, b₅, b₆, b₇, b₈, ...]

バイト 0 = b₀ | (b₁ << 1) | (b₂ << 2) | ... | (b₇ << 7)

バイト 1 = b₈ | (b₉ << 1) | ...

| ビット位置 | バイトインデックス | バイト内ビット位置 |

|---|---|---|

| 0 | 0 | 0 (LSB) |

| 1 | 0 | 1 |

| 7 | 0 | 7 (MSB) |

| 8 | 1 | 0 (LSB) |

| 63 | 7 | 7 (MSB) |

64 ビットのビットマップは 8 バイトにパッキングされます。

32 バイトチャンク分割

パッキングされたバイト列は 32 バイト(256 ビット)単位のチャンクに分割されます。各チャンクが Merkle ツリーの 1 つのリーフとなります。

- 1 チャンク = 32 バイト = 256 ビット分の投票カウント状態

- 最後のチャンクが 32 バイトに満たない場合はゼロパディング

本 PoC の 64 票は 8 バイトであるため、1 つのチャンク(24 バイトのゼロパディング付き)に収まります。

Merkle ツリーの構築

ハッシュ規則

ビットマップ Merkle ツリーは、CT Merkle ツリーと同一のハッシュ規則を使用します。

リーフハッシュ:

LeafHash = SHA-256(0x00 || "stark-ballot:leaf|v1" || chunk)

内部ノードハッシュ:

NodeHash = SHA-256(0x01 || left_hash || right_hash)

ドメイン分離プレフィックス(0x00 / 0x01)と使用タグ("stark-ballot:leaf|v1")は、CT Merkle ツリーの章で解説したものと同一です。

ツリー構築アルゴリズム

- 各 32 バイトチャンクにリーフハッシュを適用

- ボトムアップでペアを結合し、内部ノードハッシュを計算

- 奇数ノードがある場合は、そのまま次のレベルに昇格(ハッシュなし)

- ルートに到達するまで繰り返す

graph TD

subgraph "3 チャンクの場合"

R["ルート<br/>SHA-256(0x01 || N1 || C2)"]

N1["ノード<br/>SHA-256(0x01 || C0 || C1)"]

C2["リーフ 2<br/>SHA-256(0x00 || tag || chunk₂)"]

C0["リーフ 0<br/>SHA-256(0x00 || tag || chunk₀)"]

C1["リーフ 1<br/>SHA-256(0x00 || tag || chunk₁)"]

R --> N1

R --> C2

N1 --> C0

N1 --> C1

end

Merkle 証明の生成と検証

証明の構造

GET /api/bitmap-proof?i=<bitIndex>&kind=included|seen のレスポンスは、以下の要素で構成されます:

| フィールド | 説明 |

|---|---|

| leafChunk | 対象ビットを含む 32 バイトチャンク(16 進数) |

| auditPath | ルートまでの兄弟ハッシュ配列(各要素にハッシュ値と位置) |

leafIndex(floor(bitIndex / 256))と bitOffset(bitIndex mod 256)は、クライアント側で bitIndex クエリから導出します。サーバーは返しません。

kind は省略可能で、既定値は included です。

kind=included:includedBitmapRootに対する証明を返すkind=seen:seenBitmapRootに対する証明を返す

この endpoint はセッション ID と capability token によるセッションスコープ認証を前提とした証明材料 API であり、公開 API ではありません。

ビット抽出

投票者は受け取ったチャンクから、自分が指定した bitIndex のビットを以下の手順で抽出します:

bit_offset = bit_index mod 256

byte_index = bit_offset / 8 (整数除算)

bit_in_byte = bit_offset mod 8

included = (chunk[byte_index] AND (1 << bit_in_byte)) != 0

kind=included で included = true なら、自分の投票がカウントされたことを意味します。kind=seen で included = true なら、自分の投票が prover に提示されたことを意味します。

検証手順

- チャンクからビット値を抽出し、自分の投票がカウントされたか確認

- チャンクのリーフハッシュを計算:

SHA-256(0x00 || "stark-ballot:leaf|v1" || chunk) - 監査パスに沿ってルートまで再計算:

- 兄弟の位置が

left→SHA-256(0x01 || sibling || current) - 兄弟の位置が

right→SHA-256(0x01 || current || sibling)

- 兄弟の位置が

- 計算されたルートが、

kindに対応するジャーナル上のルートと一致するか確認kind=included→includedBitmapRootkind=seen→seenBitmapRoot

flowchart TD

CK[チャンク受信] --> EX[ビット抽出<br/>included = true/false]

CK --> LH["リーフハッシュ計算"]

LH --> AP[監査パスに沿って<br/>ルートを再計算]

AP --> CMP{計算ルート =<br/>bitmap root ?}

CMP -->|一致| V[証明有効]

CMP -->|不一致| IV[証明無効]

zkVM ゲストとの連携

ビットマップルートは zkVM ゲストプログラム内で計算され、ジャーナルにコミットされます。

ゲストプログラムは以下の手順を実行します:

- 各投票に対してコミットメントの再計算と包含証明の検証を実施

- prover に提示された投票インデックスを

seenBitmapに記録 - 検証に成功して集計対象になった投票インデックスを

includedBitmapに記録 - それぞれのビットマップを LSB-first でパッキングし、32 バイトチャンクに分割

- CT スタイルのハッシュ規則で Merkle ルートを計算

seenBitmapRootとincludedBitmapRootをジャーナルにコミット

この計算はゲスト内で行われるため、STARK 証明がビットマップの正しさも保証します。サーバーが事後的にビットマップを改ざんしても、ジャーナルのルート値と一致しなくなるため検出されます。

サーバーのビットマップデータ管理

サーバーはビットマップ Merkle 証明を提供するために、最終化時に zkVM 出力に基づく bitmap データを保持します。

現行実装では、sync finalize でも async finalize でも、zkVM 実行から includedBitmap が得られた場合にのみ証明用データを保存します。seenBitmap と seenBitmapRoot が得られた場合は、それも private artifact として保存します。validVotes から簡易ビットマップを推定する fallback は現在の実装にはありません。

安全性ゲート

サーバーが保持するビットマップデータから計算したルートと、ジャーナル上の対応ルート(includedBitmapRoot または seenBitmapRoot)が一致しない場合、ビットマップ証明の提供は無効化されます。これにより、サーバーが不正なビットマップデータを使って偽の証明を生成することを防止します。

そのため、zkVM 出力に基づく bitmap データが存在しない場合や、保存済みデータの root がジャーナルと一致しない場合は、証明を提供せず counted_my_vote_included は not_run 相当になります。

さらに現行実装では、counted_my_vote_included の評価には信頼できる voteReceipt.bulletinIndex が必要です。この値は、store から cast-time 証跡(voteReceipt / userVote.proof)を再構成できた場合にのみ得られます。bitmap データが保持されていても cast-time 証跡を復元できなければ bitmap proof は実行されず、counted_my_vote_included は not_run(証拠不足による fail-closed)となります。

async finalize 経路でも、prover 出力の *-bitmap.json と *-seen-bitmap.json は private な included-bitmap.json / seen-bitmap.json として保持されます。これらは public bundle.zip には含めず、必要に応じて S3 上の sibling object から復元されます。

検証パイプラインにおける役割

ビットマップ Merkle 証明は、Counted-as-Recorded 段階のチェックとして使用されます。

| チェック ID | 検証内容 |

|---|---|

counted_my_vote_included | ビットマップ Merkle 証明により、自分の投票インデックスがカウントされたことを確認する |

seenBitmapRoot が利用可能な場合は、このチェックが「prover に提示されたが無効化された」と「そもそも提示されなかった」も区別して説明します。

各チェックの判定ロジックは チェック一覧 > Counted-as-Recorded を参照してください。

プライバシーに関する注意

チャンクレベルの情報漏洩

ビットマップ Merkle 証明では、対象ビットを含む 32 バイトチャンク全体がクライアントに提供されます。1 チャンクは 256 ビット分のカウント状態を含むため、近傍のインデックスのカウント状態が同時に開示されます。

本 PoC では 64 票が 1 チャンクに収まるため、チャンクを受け取った投票者は全 64 票のカウント状態を知ることができます。この漏洩の影響評価は PoC の意図的な制約 > ビットマップチャンク漏洩 を参照してください。

PoC における許容性

本システムでは 63 票がボット(自動投票)であり、ボットのカウント状態が開示されても実質的なプライバシー侵害は生じません。人間の投票者が多数参加するシステムでは、以下のような緩和策が考えられます:

- チャンクサイズの縮小(より多くのリーフ、より深いツリー)

- ゼロ知識証明を用いたビット開示の最小化

- 投票者の明示的な同意に基づく開示

zkVM 設計

RISC Zero zkVM を用いた集計証明パイプラインの全体設計を解説します。

この部に含まれる章

- zkVM の基礎 — zkVM の概念、RISC Zero の選択理由、データフロー、保証境界

- ゲストプログラム — zkVM 内で実行される検証・集計ロジック

- ホストと証明生成 — ホストプログラムと同期/非同期の証明パス

- 検証サービス — Rust ベースのレシート検証

- Image ID — ゲストバイナリの暗号的識別子と管理

zkVM の基礎

RISC Zero zkVM の基本概念、本システムでの選択理由、パイプラインの全体データフローと保証境界を解説します。

なぜ RISC Zero か

- Trusted setup 不要で扱いやすい。

- RISC-V 上で通常の Rust コードを使えるため、実装と監査の往復がしやすい。

- Image ID による実行バイナリ照合と組み合わせやすい。

アーキテクチャ概要

zkVM パイプラインは 3 つのコンポーネントで構成されます。

flowchart TB

subgraph C1["第1フェーズ: 入力構築"]

SES[セッションデータ] --> IB[入力ビルダー]

IB --> INP[ZkVMInput]

end

subgraph C2["第2フェーズ: 証明生成"]

INP --> HOST[ホストプログラム]

HOST --> GUEST["ゲストプログラム<br/>(zkVM 内実行)"]

GUEST --> JNL[ジャーナル]

HOST --> RCP[レシート<br/>STARK 証明]

end

subgraph C3["第3フェーズ: 検証"]

RCP --> VS[検証サービス]

VS --> VR[検証レポート]

end

| コンポーネント | 言語 | 責務 |

|---|---|---|

| ゲストプログラム | Rust | zkVM 内で投票を検証・集計し、結果をジャーナルにコミットする |

| ホストプログラム | Rust | 入力を受け取り、zkVM を起動して STARK 証明(レシート)を生成する |

| 検証サービス | Rust | レシートの STARK 検証を実行し、期待される Image ID との一致を確認する |

zkVM とは

RISC Zero zkVM は、RISC-V(RV32IM)命令列として実行されるゲストプログラムに対して、その実行が正しいことを STARK 証明で示すゼロ知識 VM です。

本システムでは「投票検証と集計」をゲストとして実行し、ホストがレシート(seal + journal)を生成します。第三者は Receipt::verify(image_id) により、指定したゲストバイナリ(Image ID)で実行された結果であることを検証できます。

30 秒で要点

| 観点 | 要点 |

|---|---|

| 何を証明するか | 「このゲストコードをこの入力で実行した結果がジャーナルである」こと |

| 何を公開するか | ジャーナル(公開出力)とレシート(証明本体) |

| どこが信頼アンカーか | Image ID(どのゲストを検証対象にするか) |

| この PoC での意味 | 集計値・除外件数・入力整合性を暗号学的に検証可能にする |

ジャーナルは証明に束縛される公開出力です。配布対象ファイル(bundle.zip 等)との違いは バンドル構造 を参照してください。

RISC Zero zkVM 実装の要点(簡潔版)

RISC Zero 公式ドキュメントに基づく実装上の要点:

- 実行モデル: ゲストは RV32IM として決定論的に実行され、外部との境界は syscall (

ecall) で扱う - 証明の分割: 長い実行はセグメント証明に分割される(大規模実行を扱うため)

- 再帰合成: セグメント証明を再帰的に合成して、最終的に短いレシートへ圧縮する

- 検証 API:

Receipt::verify(image_id)が、証明本体と Image ID の束縛を同時に検証する - 公開出力の束縛:

journalは証明に束縛されるため、検証成功後に改ざんできない

ジャーナルとレシート

- ジャーナル: ゲストが公開出力としてコミットするデータ(検証済み集計、除外情報、入力コミットメントなど)

- レシート: ジャーナルと STARK 証明(seal)のペア。検証成功時、ジャーナルは正しいゲスト実行結果として受理できる

flowchart TB R[レシート] R --> S[Seal<br/>STARK 証明] R --> J[ジャーナル<br/>公開出力]

各項目の意味と、対応する検証チェック:

| ジャーナル項目 | 代表フィールド | 主な確認ポイント |

|---|---|---|

| 検証済み集計 | verifiedTally | counted_tally_consistent |

| 除外/欠落情報 | missingSlots / invalidPresentedSlots / excludedSlots | counted_missing_indices_zero |

| 入力整合性 | inputCommitment | counted_input_commitment_match |

| STH 束縛 | sthDigest | recorded_sth_third_party(設定時) |

| 個票包含証明の根 | includedBitmapRoot | counted_my_vote_included |

| 提示状態ビットマップ根 | seenBitmapRoot | 除外理由の切り分けに使用 |

ジャーナルのフィールド名(missingSlots 等)と一部チェック名(counted_missing_indices_zero 等)が異なるのは後方互換のためです。詳細は ゲストプログラム を参照してください。

数学ミニ補足(読み飛ばし可)

STARK の直感的理解に必要な最小限の説明だけを記します。

1. 巡回ドメイン(cyclic domain)

有限体 F の乗法群の部分群 H = {1, w, w^2, ..., w^(n-1)} を評価点集合(ドメイン)として使います。RISC Zero はこれを cyclic domain と呼びます。実行トレース(レジスタ値や遷移)は、この H 上で評価される多項式として扱われます。

2. 有限体上の多項式除算

制約違反の有無は、概念的には次の形で整理できます。

- 制約多項式を

C(x)とする - 評価領域

Hの零化多項式をZ_H(x)とする(典型例:Z_H(x) = x^n - 1) - すべての点で制約を満たすなら

C(h)=0(h in H)となり、C(x)はZ_H(x)で割り切れる - したがって

Q(x) = C(x) / Z_H(x)が多項式として成立するかを検査すれば、制約満足性をチェックできる

実際の STARK では、これを FRI(Fast Reed-Solomon IOP)と Merkle コミットメントを組み合わせて効率的に検証します。

この PoC での保証境界

Receipt::verify(image_id) の成功は強い保証ですが、それ単体で「全票が提示された」ことまでは保証しません。本 PoC では以下を組み合わせて最終判定します。

- STARK 検証成功(正しいゲスト実行)

excludedSlots == 0(除外スロットなし)- 一貫性証明・STH 整合の成功(設定時)

- 必須チェックが

not_run/pending/runningのままでは不合格

このため、Verified 表示は「証明 + 完全性チェック」がそろった場合にのみ成立します。

参考資料(RISC Zero 公式)

データフロー

投票セッションの開始からレシート検証までの全体的なデータフローを示します。

sequenceDiagram participant V as 投票者 participant S as サーバー participant B as 掲示板 participant H as ホスト participant G as ゲスト (zkVM) participant VS as 検証サービス Note over V,B: 投票フェーズ V->>S: 投票意図(選択肢・乱数)+ コミットメント S->>B: 掲示板に追記 S-->>V: 投票レシート (インデックス, ルート) Note over S: ボット投票を自動追加 Note over S,G: 集計フェーズ S->>S: 入力ビルダーで ZkVMInput を構築 S->>H: ZkVMInput を渡す H->>G: ゲスト実行を開始 G->>G: 各投票のコミットメント検証 G->>G: 各投票の包含証明検証 G->>G: 集計 + ビットマップ計算 G-->>H: ジャーナル出力 H-->>S: STARK レシート + ジャーナル Note over S,VS: 検証フェーズ S->>VS: STARK レシート + 期待 Image ID VS->>VS: Receipt::verify(image_id) VS-->>S: 検証レポート S-->>V: 検証結果を提供

ゲストプログラム

zkVM 内で実行されるゲストプログラムの設計を解説します。

ゲストプログラムは、投票コミットメントの再計算、RFC 6962 包含証明の検証、集計の実行、ビットマップルートの計算を行い、結果をジャーナルにコミットします。

概要

ゲストプログラムは RISC Zero zkVM 上で動作する Rust プログラムです。ホストから投票データ(選択肢・乱数・コミットメント・Merkle パスと選挙メタデータ)を受け取り、以下の処理を行います:

- 各投票の正当性検証(コミットメント再計算 + 包含証明)

- 有効投票の集計

- カウント状態と提示状態のビットマップ計算

- 入力コミットメントと STH ダイジェストの計算

- 結果のジャーナルへのコミット

ゲスト内の処理はすべて STARK 証明に含まれるため、出力(ジャーナル)の正しさが暗号学的に保証されます。

入力構造

ゲストプログラムが受け取る入力(AggregatorInput)の構造を示します。

| フィールド | 型 | 説明 |

|---|---|---|

| election_id | 16 バイト | 選挙の UUID v4 バイナリ表現 |

| bulletin_root | 32 バイト | 掲示板 Merkle ツリーの最終ルート |

| tree_size | u32 | 掲示板のリーフ数(= 投票スロット数) |

| log_id | 32 バイト | 掲示板のログ識別子 |

| timestamp | u64 | 入力構築時に採用された最新 STH スナップショットの Unix タイムスタンプ |

| total_expected | u32 | 想定される総投票数 |

| election_config_hash | 32 バイト | 選挙設定のハッシュ値 |

| votes | VoteWithProof[ ] | 投票データと Merkle パスの配列 |

各 VoteWithProof は以下のフィールドを持ちます:

| フィールド | 型 | 説明 |

|---|---|---|

| index | u32 | 掲示板上のインデックス |

| choice | u8 | 選択肢(0 = A, 1 = B, 2 = C, 3 = D, 4 = E) |

| random | 32 バイト | コミットメント計算に使用した乱数 |

| commitment | 32 バイト | 投票コミットメント値 |

| merkle_path | 32 バイト[ ] | RFC 6962 Merkle 包含証明のパスノード |

処理パイプライン

ゲストプログラムの処理は、入力検証、投票検証・集計、出力構築の 3 フェーズで構成されます。

flowchart TD

subgraph "フェーズ 1: 入力検証"

I1[入力デシリアライズ] --> I2{掲示板ルート<br/>が非ゼロ?}

I2 -->|Yes| I3{ツリーサイズ<br/>が正の値?}

I2 -->|No| FAIL[不正入力]

I3 -->|Yes| NEXT[フェーズ 2 へ]

I3 -->|No| FAIL

end

subgraph "フェーズ 2: 投票検証と集計"

NEXT --> LOOP[各投票に対して]

LOOP --> V1[6 段階検証]

V1 -->|有効| TALLY[集計に加算]

V1 -->|無効| EXCL[除外リストに追加]

TALLY --> BIT[ビットマップ更新]

end

subgraph "フェーズ 3: 出力構築"

LOOP -->|全投票完了| O1[ビットマップルート計算]

O1 --> O2[入力コミットメント計算]

O2 --> O3[STH ダイジェスト計算]

O3 --> O4[ジャーナルにコミット]

end

Note: 現行実装の入力検証で即座に reject されるのは、

bulletin_rootがゼロ値、またはtree_sizeが 0 の場合だけです。votes.length > tree_sizeのようなケースは事前 reject されず、各レコードが通常どおり処理され、重複や範囲外は後述のrejectedRecordsに反映されます。

投票の 6 段階検証

各投票に対して、以下の 6 つの検証が順に実行されます。いずれかが失敗した投票は即座に「無効」として除外され、以降の検証はスキップされます。

flowchart TD

V[投票] --> C1{"第1検証<br/>インデックス範囲チェック"}

C1 -->|失敗| INV[無効として除外]

C1 -->|成功| C2{"第2検証<br/>インデックス重複チェック"}

C2 -->|失敗| INV

C2 -->|成功| C3{"第3検証<br/>選択肢範囲チェック"}

C3 -->|失敗| INV

C3 -->|成功| C4{"第4検証<br/>コミットメント再計算と照合"}

C4 -->|失敗| INV

C4 -->|成功| C5{"第5検証<br/>コミットメント重複チェック"}

C5 -->|失敗| INV

C5 -->|成功| C6{"第6検証<br/>包含証明検証"}

C6 -->|失敗| INV

C6 -->|成功| VALID[有効: 集計に加算]

1. インデックス範囲チェック

投票のインデックスが 0 以上 tree_size 未満であることを確認します。範囲外のインデックスは掲示板上に存在し得ないため、不正入力として検出されます。

2. インデックス重複チェック

同一インデックスの投票が既に処理されていないことを確認します。重複するインデックスは二重カウント攻撃を意味するため、2 番目以降の同一インデックスは除外されます。

3. 選択肢範囲チェック

選択肢の値が 0 から 4(A から E)の範囲内であることを確認します。

4. コミットメント再計算と照合

ゲスト内で投票者の(選択肢, 乱数, 選挙 ID)からコミットメントを再計算し、入力として渡されたコミットメント値と照合します。

この検証により、投票者が主張する選択肢が掲示板上のコミットメントと一致することが保証されます。コミットメントの計算規則は コミットメントスキーム を参照してください。

5. コミットメント重複チェック

同一コミットメントが既に処理されていないことを確認します。コミットメント値が重複した場合は、入力の異常または二重投入の兆候として無効化されます。

6. RFC 6962 包含証明検証

投票のコミットメントが掲示板 Merkle ツリーに含まれることを、RFC 6962 PATH 関数ベースの CT スタイル包含証明で検証します。投票のインデックスと Merkle パスから掲示板ルートを再計算し、入力の bulletin_root と一致するかを確認します。

ハッシュ規則は CT Merkle ツリー の RFC 6962 参照規則に合わせます:

- リーフ:

SHA-256(0x00 || "stark-ballot:leaf|v1" || data) - ノード:

SHA-256(0x01 || left || right)

集計ロジック

6 段階検証をすべて通過した投票は「有効」として集計に加算されます。

- 集計は選択肢ごとの配列(5 要素)で管理

- 有効投票のインデックスに対応するビットマップのビットを

trueに設定 - 無効投票はカウントされず、ビットマップのビットも

falseのまま

スロット / レコード分離モデル

現行のゲストプログラムは、掲示板スロットに対する完全性と、入力レコードの異常を別々に記録します。

flowchart LR TS["ツリーサイズ<br/>(全スロット)"] TS --> CNT["カウント済み<br/>validVotes"] TS --> INV["提示されたが未計上<br/>invalidPresentedSlots"] TS --> MIS["未提示<br/>missingSlots"] REC["入力レコード"] --> REJ["却下レコード<br/>rejectedRecords"]

| 指標 | 条件 | 意味 |

|---|---|---|

validVotes | 6 段階検証をすべて通過した範囲内かつ初出の投票 | 集計に含まれたスロット数 |

invalidPresentedSlots | 範囲内かつ初出のスロットが提示されたが、最終的に計上されなかった | 提示はされたがカウントに失敗したスロット数 |

missingSlots | 範囲内スロットが一度も提示されなかった | サーバーが prover に提示しなかったスロット数 |

rejectedRecords | 検証に失敗したレコード全体 | 重複 index、範囲外 index、重複 commitment なども含むレコード単位の却下数 |

スロット単位の 3 分類は、現行実装では常に次の関係を満たします:

validVotes + invalidPresentedSlots + missingSlots = treeSize

fail-closed 判定に使われる除外数は、スロット単位の excludedSlots です:

excludedSlots = missingSlots + invalidPresentedSlots

excludedSlots > 0 は検証失敗の決定的な指標です。1 スロットでも未提示または未計上であれば、集計結果の完全性が損なわれていることを意味します。

一方で rejectedRecords はレコード単位の補助指標です。たとえば次のようなケースでは rejectedRecords は増えても excludedSlots は増えません。

- 既に正しくカウント済みのスロットに対する重複インデックスレコード

tree_sizeの外側を指す範囲外レコード

以下のフィールドは現行ゲストの正規出力ではなく、TypeScript 側で導出される後方互換エイリアスです。

| 後方互換エイリアス(TS 側で導出) | 導出元 |

|---|---|

excludedCount | excludedSlots |

missingIndices | missingSlots |

invalidIndices | invalidPresentedSlots |

countedIndices | validVotes |

ジャーナル出力

ゲストプログラムがジャーナルにコミットする出力構造(VerificationOutput)を示します。

| フィールド | 型 | 説明 |

|---|---|---|

| electionId | UUID | 対象選挙 ID(入力の election_id をエコー) |

| electionConfigHash | 32 バイト | 選挙設定ハッシュ(入力の election_config_hash をエコー) |

| bulletinRoot | 32 バイト | 掲示板ルート(入力の bulletin_root をエコー) |

| treeSize | u32 | 掲示板のツリーサイズ(入力をエコー) |

| totalExpected | u32 | 想定総投票数(入力をエコー) |

| sthDigest | 32 バイト | STH ダイジェスト |

| verifiedTally | u32[5] | 選択肢 A〜E ごとの得票数 |

| totalVotes | u32 | zkVM が受け取った投票レコード数 |

| validVotes | u32 | 検証に成功した投票数 |

| invalidVotes | u32 | 検証に失敗した投票数 |

| seenIndicesCount | u32 | 範囲内かつ初出のインデックスとして処理した件数 |

| missingSlots | u32 | 一度も提示されなかった掲示板スロット数 |

| invalidPresentedSlots | u32 | 提示はされたが計上されなかった範囲内スロット数 |

| rejectedRecords | u32 | 却下されたレコード数(重複・範囲外・各種検証失敗を含む) |

| seenBitmapRoot | 32 バイト | prover に提示されたインデックス集合の ビットマップ Merkle ルート |

| includedBitmapRoot | 32 バイト | 実際にカウントされたインデックス集合の ビットマップ Merkle ルート |

| excludedSlots | u32 | 除外されたスロットの総数(= missingSlots + invalidPresentedSlots) |

| inputCommitment | 32 バイト | 入力コミットメント |

| methodVersion | u32 | ゲストプログラムのバージョン(現行 = 12 / v1.2) |

ジャーナルの信頼モデル

ジャーナルの各フィールドは、対応する STARK 証明により「ゲストプログラムが正しく計算した結果」であることが保証されます。

| ジャーナル項目 | STARK 証明で保証される内容 | 補足 |

|---|---|---|

verifiedTally | 有効投票のみを正しく集計した結果である | validVotes / invalidVotes との整合もジャーナル上で確認可能 |

excludedSlots | 未提示または未計上のスロット数がゲストの計算結果と一致する | excludedSlots > 0 は完全性違反の重要シグナル |

rejectedRecords | 却下されたレコード数がゲストの計算結果と一致する | 重複・範囲外・検証失敗の説明に使う補助情報で、スロット単位の判定とは分離される |

inputCommitment | ゲストが処理した入力データを正準エンコードで束縛した値である | 公開入力側から再計算して照合できる |

seenBitmapRoot | prover に提示された範囲内かつ初出のインデックス集合から計算したルートである | includedBitmapRoot と併用すると未提示 / 提示されたが未計上 / カウント済みを区別できる |

includedBitmapRoot | 実際にカウントされたインデックス集合から計算したルートである | 自票包含の証明(bitmap proof)の検証基準になる |

sthDigest | その実行で参照した掲示板状態から計算した値である | 第三者 STH 合意そのものは別チェックで確認する |

第三者はレシートの STARK 検証を行うだけで、上記の保証を取得できます。ゲストプログラムのロジックを信頼する必要はありますが、ホストやサーバーの正直性を信頼する必要はありません。

ビットマップルートの計算

ゲストプログラムは投票検証と並行して、2 種類のビットマップを構築します。

seenBitmapとincludedBitmapの 2 つのブール配列を初期化(全false)- 範囲内かつ一意インデックスとして処理された票のインデックスに対応する

seenBitmapのビットをtrueに設定 - 6 段階検証を通過した票のインデックスに対応する

includedBitmapのビットをtrueに設定 - 各ビットマップを LSB-first でバイト列にパッキング

- パック後の長さが 32 バイト以下なら、ゼロ埋めした 1 リーフとして CT スタイルの leaf hash を計算

- 33 バイト以上なら 32 バイトチャンクに分割し、それぞれを leaf とする CT スタイルの Merkle ツリーを構築

- 2 つのルート値(

seenBitmapRootとincludedBitmapRoot)をジャーナルにコミット

この 2 つのルートを使うことで、公開検証側は「prover に提示されたが無効化された票」と「そもそも prover に提示されなかった票」を区別できます。

ビットマップの詳細な構造とハッシュ規則は ビットマップ Merkle を参照してください。

入力コミットメントと STH ダイジェスト

ゲストプログラムは投票処理の後、2 つの追加ハッシュ値を計算してジャーナルにコミットします。

入力コミットメント

ゲストに渡された入力のうち、公開フィールドを正準エンコーディングで連結し SHA-256 で圧縮します。現行実装では固定のドメインタグと format version を先頭に付与した上で、electionId・bulletinRoot・treeSize・totalExpected・votesCount と各投票の index・コミットメント値・Merkle パスを束縛します。投票列はハッシュ前にインデックス順へ正規化されます。

第三者は public-input.json などの公開検証用レコードから同じ値を再計算し、ジャーナルの値と照合することで、zkVM が処理した入力の同一性を検証できます。

詳細は 入力コミットメント を参照してください。

STH ダイジェスト

掲示板のログ ID、ツリーサイズ、タイムスタンプ、ルートハッシュを結合して SHA-256 で圧縮します。このダイジェストは第三者の STH ソースとの照合に使用され、サーバーが異なる投票者に異なる掲示板ビューを提示する分割ビュー攻撃を緩和します。

詳細は STH ダイジェスト を参照してください。

ゲストプログラムのバージョニング

ゲストプログラムにはバージョン番号が割り当てられ、ジャーナルの methodVersion フィールドに記録されます。現行のジャーナル契約は 12(v1.2)です。

バージョン番号は Image ID の管理と連動しており、ゲストプログラムの変更は新しい Image ID の生成を伴います。検証時には、期待 Image ID との一致が確認されます。

ホストと証明生成

ホストプログラムによる zkVM 入力構築と STARK 証明生成の仕組みを解説します。

同期モード(ローカルプロセス起動)と非同期モード(ECS Fargate タスク)の 2 つの証明パスがあり、どちらも同一のホストバイナリを使用します。入力構築からレシート出力までのフローを、両モードの差異とともに説明します。

パイプライン全体像

証明生成パイプラインは、入力構築、ホスト実行、出力処理の 3 フェーズで構成されます。

flowchart TD

subgraph "第1フェーズ: 入力構築 (TypeScript)"

SD[セッションデータ] --> IB[入力ビルダー]

IB --> ZI[ZkVMInput]

ZI --> SER[シリアライズ<br/>JSON ファイル]

end

subgraph "第2フェーズ: ホスト実行 (Rust)"

SER --> HOST[ホストバイナリ]

HOST --> ENV[ExecutorEnv 構築]

ENV --> PROVER[デフォルトプローバー]

PROVER --> GUEST[ゲスト実行]

GUEST --> PROOF[STARK 証明生成]

end

subgraph "第3フェーズ: 出力処理"

PROOF --> RCP["レシート JSON<br/>(seal + journal)"]

PROOF --> OUT["出力 JSON<br/>(デコード済みジャーナル)"]

end

入力構築

セッションデータからの抽出

入力ビルダーは、投票セッションに蓄積されたデータから zkVM 入力を構築します。

flowchart LR

subgraph セッションデータ

EID[選挙 ID]

VOTES["投票データ<br/>(選択肢, 乱数, コミットメント)"]

BULL["掲示板<br/>(ルート履歴, 包含証明)"]

LID[ログ ID]

end

subgraph ZkVMInput

EID2[election_id]

BR[bulletin_root]

TS[tree_size]

TE[total_expected]

VWP["votes[]<br/>(VoteWithProof)"]

LID2[log_id]

TSTAMP[timestamp]

end

EID --> EID2

BULL --> BR

BULL --> TS

VOTES --> VWP

LID --> LID2

入力構築で行われる主要な処理:

- 掲示板の最新 STH スナップショット取得: ルートハッシュ、ツリーサイズ、タイムスタンプを取得

- 投票データの変換: 各投票の選択肢を整数に変換(A=0, B=1, C=2, D=3, E=4)

- Merkle パスの解決: 各投票について、掲示板から最新の包含証明を取得

- 総投票数の設定: ボット投票数 + ユーザー投票数(本 PoC では 63 + 1 = 64)

Merkle パスの解決戦略

各投票の Merkle パスは、以下の優先順位で解決されます:

flowchart TD

START[Merkle パス解決] --> P1{掲示板から<br/>包含証明を取得可能?}

P1 -->|Yes| USE1[掲示板の証明を使用]

P1 -->|No| P2{投票データに<br/>事前計算パスが存在?}

P2 -->|Yes| CHK{proofMode = rfc6962<br/>かつ treeSize が一致?}

CHK -->|Yes| USE2[事前計算パスを使用]

CHK -->|No| ERR[エラー]

P2 -->|No| ERR

ホストプログラムの実行

ホストバイナリの役割

ホストバイナリは Rust で記述された CLI プログラムです。以下の処理を行います:

- JSON 形式の入力ファイルを読み込み

- JSON のバイト配列表現を Rust の固定長配列型へ変換(

Vec<u8>→[u8; 16/32]) ExecutorEnvに入力をシリアライズして設定- デフォルトプローバーを使用して zkVM ゲストを実行

- レシート(STARK 証明 + ジャーナル)を取得

- ジャーナルをデコードし、出力ファイルに書き出し

入力 JSON は TypeScript 側のエグゼキューターが事前に正規化して生成します(UUID/ハッシュ文字列をバイト配列へ変換)。

出力ファイル

ホストバイナリは常に 2 つの JSON ファイルを出力し、条件を満たした場合は private bitmap artifact も追加で出力します。

| ファイル | 内容 |

|---|---|

| レシート JSON | { "receipt": ..., "image_id": "0x..." } 形式のラッパー JSON |

| 出力 JSON | デコード済みのジャーナル(集計結果、除外情報、各種ハッシュ値) |

レシート JSON には top-level image_id フィールドも含まれます。検証サービスでの使われ方は 検証サービス を参照してください。

また、ホストはビットマップの整合性を確認し、一致した場合のみ以下の private artifact を出力します。

| ファイル | 内容 |

|---|---|

*-bitmap.json | counted bitmap の厳密 artifact(includedBitmapRoot と対応) |

*-seen-bitmap.json | presented bitmap の厳密 artifact(seenBitmapRoot と対応) |

同期モード

同期モードでは、TypeScript のサーバーサイドプロセスからホストバイナリを直接起動します。

sequenceDiagram participant S as サーバー (TypeScript) participant E as エグゼキューター participant H as ホストバイナリ (Rust) participant FS as ファイルシステム S->>E: executeZkVM(input) E->>FS: 入力 JSON を一時ファイルに書き出し E->>H: 子プロセスとして起動 Note over H: zkVM ゲスト実行<br/>+ STARK 証明生成 H->>FS: レシート JSON + 出力 JSON を書き出し H-->>E: プロセス終了 E->>FS: 出力ファイルを読み取り E->>FS: 一時ファイルを削除 E-->>S: ZkVMExecutionResult

同期モードの特性

| 項目 | 値 |

|---|---|

| 起動方式 | Node.js child_process.exec |

| タイムアウト | 10 分(600 秒) |

| 一時ファイル | リポジトリ直下の .zkvm-temp/ 配下 |

| 環境変数 | RISC0_DEV_MODE と RUST_LOG をパススルー |

| エラー処理 | 終了コード非ゼロ、タイムアウト、ファイル不在で失敗 |

結果の変換

エグゼキューターは出力 JSON のフィールドを TypeScript の命名規則へ正規化し、文字列だけでなくバイト配列形式の値も受理します。ハッシュ系フィールドは 0x 付き 16 進文字列に、election_id は UUID 文字列に変換して ZkVMExecutionResult を構築します。

非同期モード

AWS 環境では、証明生成を ECS Fargate タスクとして非同期に実行します。STARK 証明の生成に数分を要するため、Lambda のタイムアウト制限を回避し、専用のコンピューティングリソースを割り当てます。

sequenceDiagram participant S as サーバー participant SQS as SQS participant SFN as Step Functions participant ECS as ECS Fargate participant S3 as S3 participant CB as コールバック Lambda S->>SQS: ファイナライズリクエスト SQS->>SFN: ディスパッチ Lambda<br/>→ SFN 実行開始 Note over SFN: イメージ署名チェック SFN->>ECS: プローバータスク起動 ECS->>S3: 入力 JSON ダウンロード Note over ECS: ホストバイナリ実行<br/>+ STARK 証明生成 ECS->>S3: レシート・ジャーナル・<br/>バンドルをアップロード ECS-->>SFN: タスク完了 SFN->>CB: 成功コールバック CB->>CB: セッションデータ更新

非同期モードの処理フロー

- 入力の準備: ディスパッチ Lambda が入力 JSON を S3 にアップロードし、Step Functions 実行を開始

- イメージ署名チェック: プローバーコンテナイメージの署名を検証し、承認されたイメージのみ実行を許可

- プローバータスク: ECS Fargate タスクが起動し、S3 から入力をダウンロードしてホストバイナリを実行

- 出力バンドル: レシート、ジャーナル、

public-input.json、election-manifest.json、close-statement.jsonを生成し、整合性検査を通過したものだけをbundle.zipにまとめて S3 にアップロード - コールバック: 成功/失敗に応じてコールバック Lambda がセッションデータを更新

配布対象バンドルの構築

非同期モードでは、ホストバイナリの出力から秘密データを含まない配布対象バンドル(bundle.zip)を構築します。

ここでいう「配布対象」は機密性の分類です。用語の意味と取得経路は バンドル構造 を参照してください。

| ファイル | 内容 | 配布対象 |

|---|---|---|

| receipt.json | STARK レシートのラッパー JSON | Yes |

| journal.json | ジャーナルの正準 JSON 表現 | Yes |

| public-input.json | 秘密データを含まない検証用レコード | Yes |

| election-manifest.json | 選挙設定の公開監査用スナップショット | Yes |

| close-statement.json | 集計締切時点のログ境界を表す公開監査レコード | Yes |

秘密データを含む完全入力は非同期実行時のワーク入力として S3 や一時領域に存在し得ますが、bundle.zip には含まれません。

public-input.json、election-manifest.json、close-statement.json は、journal.json と proof-bound data に対する整合性検査を通過した場合にのみバンドルに含まれます。

public-input.json の項目と inputCommitment の関係は 入力コミットメント、配布経路は バンドル構造 を参照してください。

非同期モードの特性

| 項目 | 値 |

|---|---|

| タイムアウト | 15 分(デフォルト、環境変数で変更可能) |

| リトライ | S3 アップロードは指数バックオフで 3 回リトライ |

| エラー処理 | Step Functions がタスク失敗を検出し、失敗コールバックを実行 |

| ステータス確認 | クライアントは /api/sessions/:id/status でポーリング |

開発モードの動作

RISC0_DEV_MODE=1 を設定すると、RISC Zero は STARK 証明を生成せず、フェイクレシートを返します。

| 項目 | 開発モード (RISC0_DEV_MODE=1) | 本番モード |

|---|---|---|

| 証明の種類 | フェイクレシート | 本物の STARK 証明 |

| 実行時間 | 約 100 ミリ秒 | 約 370 秒(64 票の場合) |

| 安全性 | なし(検証を省略) | 暗号学的に完全 |

| 検証サービス | DevMode として検出 | 完全な STARK 検証を実行 |

開発モードで生成されたレシートは InnerReceipt::Fake 型となります。検証サービスでは通常 DevMode として扱いますが、image_id 不一致などの事前条件違反があれば Failed になります。本番環境でフェイクレシートが混入した場合は検証失敗です。

flowchart TD

ENV{RISC0_DEV_MODE?}

ENV -->|"= 1"| DEV["開発モード<br/>フェイクレシート生成<br/>約 100ms"]

ENV -->|未設定| PROD["本番モード<br/>STARK 証明生成<br/>約 370 秒"]

DEV --> FAKE["InnerReceipt::Fake"]

PROD --> REAL["InnerReceipt::Composite<br/>+ seal データ"]

開発モードは以下の用途に限定されます:

- ローカル開発での高速フィードバック

- E2E テストの高速実行

- UI 開発時のモック

開発モードのレシートは 検証サービス で Fake として検出され、通常は DevMode 扱いになります(image_id 不一致などの事前条件違反時は Failed)。いずれにせよ本番モードの検証基準は満たしません。

検証サービス

Rust ベースの STARK レシート検証サービスの設計を解説します。

レシートの STARK 検証をサーバー側で行い、結果をレポートとしてクライアントに提供する Rust コンポーネントです。

概要

STARK 証明の検証は計算コストが証明生成に比べて低いものの、ブラウザ上で RISC Zero の検証ロジックを実行することは現時点では実用的ではありません。そのため、本システムではサーバー側で検証を行い、その結果をレポートとしてクライアントに提供する設計を採用しています。

flowchart LR

subgraph 入力

RCP[レシート / バンドル]

EID["期待 Image ID"]

end

RCP --> VS[検証サービス]

EID --> VS

VS --> RPT[検証レポート]

検証フロー

検証サービスは以下の手順でレシートを検証します。

flowchart TD

START[レシート / バンドル読み込み] --> FORMAT{入力形式<br/>の判定}

FORMAT -->|フラット JSON| F1[直接パース]

FORMAT -->|ネスト JSON| F2[receipt フィールドを抽出]

FORMAT -->|ディレクトリ| F3[receipt.json または<br/>*-receipt.json を探索]

FORMAT -->|ZIP アーカイブ| F4[末尾が receipt.json のファイルを探索]

F1 --> EXTRACT[Image ID 抽出]

F2 --> EXTRACT

F3 --> EXTRACT

F4 --> EXTRACT

EXTRACT --> MODE[InnerReceipt を判定<br/>Fake は dev_mode 候補として記録]

MODE --> PRESENT{メタデータ image_id<br/>が存在?}

PRESENT -->|欠落 + 非 Fake| FAIL0[failed]

PRESENT -->|欠落 + Fake| VERIFY

PRESENT -->|存在| MATCH{メタデータ Image ID<br/>= 期待 Image ID ?}

MATCH -->|不一致| FAIL1[failed:<br/>Image ID 不一致]

MATCH -->|一致| VERIFY["Receipt::verify(expected_image_id)<br/>STARK 検証実行"]

VERIFY -->|成功 かつ Fake| DEVMODE[dev_mode]

VERIFY -->|失敗 かつ Fake + InvalidProof| DEVMODE

VERIFY -->|成功 かつ 非 Fake| SUCCESS[success]

VERIFY -->|失敗(その他)| FAIL2[failed]

1. レシートの読み込みとパース

検証サービスは単一のレシート JSON だけでなく、レシートを含むバンドルディレクトリや ZIP にも対応しています。

| 形式 | 説明 |

|---|---|

| フラット JSON | レシートオブジェクトが直接 JSON のトップレベルにある |

| ネスト JSON | { "receipt": {...}, "image_id": "0x..." } 構造 |

| ディレクトリ | receipt.json または *-receipt.json を探索して読み込む |

| ZIP アーカイブ | エントリ名の末尾が receipt.json のファイルを探索して読み込む |

image_id はラッパーの top-level フィールドであり、レシート本体の内部フィールドではありません。

同期ファイナライズ経路では、proof bundle ディレクトリ全体を verifier-service に渡し、その中の receipt.json を解決させる実装になっています。

2. 開発モードの検出

レシートの内部構造(InnerReceipt)が Fake 型の場合、開発モードで生成されたレシートです。ただし即 dev_mode にはならず、Image ID 照合を経て最終ステータスが決まります。分岐の詳細は上のフローチャートを参照してください。

3. Image ID の照合

ラッパーの image_id を期待値と照合し、不一致なら failed として即時拒否します。Image ID の管理については Image ID を参照してください。

4. STARK 検証の実行

Image ID の照合に成功した後、RISC Zero SDK の Receipt::verify(expected_image_id) メソッドを使用して STARK 証明の暗号学的検証を行います。

この検証は以下のことを証明します:

- レシートに含まれる seal(証明データ)が有効である

- ジャーナルの内容が、指定された Image ID のゲストプログラムの正当な実行結果である

- 証明の生成時にデータの改ざんが行われていない

検証レポート

検証サービスは、検証が最後まで到達した試行について JSON レポートを出力します。

引数不正や bundle 不在のような一般エラーは exit code 1 で終了し、JSON レポートは出力しません。

| フィールド | 型 | 説明 |

|---|---|---|

| status | 列挙型 | success / failed / dev_mode |

| verifier_version | 文字列 | verifier-service のバージョン |

| verified_at | 文字列 | RFC 3339 形式の検証完了時刻 |

| duration_ms | 数値 | 検証処理時間(ミリ秒) |

| expected_image_id | 文字列 | 検証に使用した期待 Image ID |

| receipt_image_id | 文字列? | 入力 JSON の top-level image_id から抽出した値 |

| bundle_path | 文字列 | 入力 bundle パスの basename のみ |

| receipt_path | 文字列 | 解決されたレシートファイル名の basename のみ |

| dev_mode_receipt | 真偽値 | フェイクレシートであるか |

| errors | 文字列[] | 診断文字列の配列。空の場合は省略される |

ステータスの判定基準

flowchart TD

S{検証結果}

S -->|"metadata image_id 不一致"| F1["failed<br/>errors: 不一致の診断文字列"]

S -->|"Receipt::verify(expected_image_id) 成功 + 非 Fake"| OK["success"]

S -->|"Receipt::verify(expected_image_id) 成功 + Fake"| DM["dev_mode"]

S -->|"Receipt::verify(expected_image_id) 失敗 + Fake + InvalidProof"| DM2["dev_mode"]

S -->|"Receipt::verify(expected_image_id) 失敗(その他)"| F2["failed<br/>errors: 検証失敗の診断文字列"]

errors は固定のエラーコード一覧ではなく、実装が積む自由形式の診断文字列です。

| ステータス | 意味 | UI への影響 |

|---|---|---|

success | STARK 検証が成功し、Image ID も一致 | STARK Verified を表示可能 |

failed | Image ID 不一致または STARK 検証失敗 | 検証失敗として表示 |

dev_mode | 開発モードのフェイクレシート | 開発モード警告を表示 |

デプロイメントモデル

検証サービス(Rust バイナリ verifier-service)は、呼び出し経路ごとに実行場所が異なります。

- 同期ファイナライズ(

POST /api/finalize): real executor 利用時のみ API サーバープロセスがローカルに配置されたバイナリを直接実行(mock executor 利用時は verifier-service を呼ばずdev_mode扱い) - 明示的検証(

POST /api/verification/run): verifier-service-runner Lambda が S3 バンドルを展開してバイナリを実行

sequenceDiagram participant C as クライアント participant API as API サーバー participant RUNNER as verifier-service-runner Lambda participant VS as verifier-service バイナリ participant S3 as S3 C->>API: POST /api/verification/run API->>RUNNER: 実行要求(sessionId, executionId, expectedImageId) RUNNER->>S3: レシートバンドルを取得・展開 RUNNER->>VS: レシート + 期待 Image ID + reportPath VS->>VS: STARK 検証実行 + verification.json 書き出し VS-->>RUNNER: 検証レポート RUNNER-->>API: 検証レポート API->>API: verificationResult / execution 状態を更新 API-->>C: 検証結果

呼び出しパターン

検証サービスの呼び出しには 2 つのパターンがあります。

| パターン | トリガー | 説明 |

|---|---|---|

| 同期実行 | 同期ファイナライズ (POST /api/finalize) | real executor 時のみ、サーバー内の proof-bundle ディレクトリを verifier-service に渡して実行 |

| 明示的実行 | クライアントが検証を要求 | POST /api/verification/run 経由で verifier-service-runner Lambda が S3 バンドルを展開して実行 |

非同期ファイナライズのコールバック Lambda は、結果の復元と保存を担当します。STARK 検証は自動実行されず、POST /api/verification/run で実行します。

検証パイプラインにおける役割

検証サービスは、4 段階検証モデルの最終段階である STARK 検証を担当します。

| チェック ID | 検証内容 |

|---|---|

stark_image_id_match | レシートに記録された Image ID が期待値と一致するか |

stark_receipt_verify | STARK 証明が暗号学的に有効であるか |

stark_image_id_match は verifier report の expected_image_id と receipt_image_id の一致を主に検証します。検証フロー側では、これに加えて claimed / comparison 側の Image ID との整合も確認します。

これらのチェックが両方成功した場合に限り、「STARK Verified」のステータスが付与されます。詳細は 4 段階検証モデル を参照してください。

セキュリティ上の考慮事項

サーバー側検証の信頼境界

検証サービスはサーバー側で実行されるため、クライアントはサーバーの検証結果を信頼する必要があります。この PoC における信頼モデルは以下の通りです:

- STARK 証明自体は秘密データを含まない検証データ: レシートと Image ID があれば、第三者が独立に検証可能

- 検証サービスは利便性のための委任: ブラウザでの STARK 検証が実用的になれば、クライアント側のみで完結させることも理論上は可能

- 配布対象バンドル: レシートと

public-input.jsonは ZIP ローカル検証(Ubuntu) の手順で独立検証できる

verification.json の非公開性

verification.json は配布対象バンドル(bundle.zip)には含まれません。必要に応じてレポート用の capability 保護エンドポイント経由で配布されますが、第三者検証ではレシートファイルを直接使った独立検証が推奨されます。

Image ID

zkVM ゲストバイナリの暗号的識別子(Image ID)の管理と検証を解説します。

Image ID はゲストプログラムの ELF バイナリから決定的に導出される 256 ビットのハッシュ値です。レシート検証時に期待値との一致を確認することで、正しいプログラムの実行結果であることを保証します。

概要

RISC Zero zkVM では、ゲストプログラムの ELF バイナリが Image ID と呼ばれる 256 ビットの識別子に変換されます。この変換は決定的であり、同一のバイナリからは常に同一の Image ID が生成されます。

Receipt::verify(image_id) はレシートが指定した Image ID のゲスト実行結果であることを暗号学的に検証します。期待する Image ID と一致しないレシートは拒否されます。ラッパーメタデータとの照合手順は 検証サービス を参照してください。

flowchart LR ELF["ゲスト ELF バイナリ"] --> HASH["RISC Zero<br/>Image ID 導出"] HASH --> IID["Image ID<br/>(256 ビット)"] IID --> EMBED["ホストバイナリに埋め込み"] IID --> MAP["マッピングファイルに記録"] IID --> VS["検証サービスの期待値"]

Image ID の導出

Image ID は RISC Zero のビルドシステムによってコンパイル時に自動生成されます。

決定論的導出

同一のゲストソースコードであっても、以下の要因により異なる Image ID が生成され得ます:

| 要因 | 影響 |

|---|---|

| ゲストコードの変更 | ロジックの変更は異なるバイナリを生成 |

| コンパイラバージョン | Rust ツールチェインのバージョン差異 |

| ターゲットアーキテクチャ | 同一コードでも x86_64 と ARM64 で異なる Image ID |

| RISC Zero SDK バージョン | SDK の変更がゲストバイナリの構造に影響 |

アーキテクチャによる差異

本システムでは、同一バージョンのゲストに対して ARM64 用 (expectedImageID) と x86_64 用 (expectedImageID_x86_64) の 2 つの Image ID をマッピング上で管理できます。

| アーキテクチャ | 用途 |

|---|---|

| ARM64 | ECS Fargate (Graviton) での本番証明生成 |

| x86_64 | ローカル開発、CI/CD 環境での証明生成 |

アプリ/サーバー実装では、WSL 環境でのみ expectedImageID_x86_64 を自動選択し、それ以外は expectedImageID を使います。CLI テストハーネスの自動選択ルールはこれと異なります。いずれの場合も EXPECTED_IMAGE_ID 環境変数で明示オーバーライドできます。

Image ID マッピング

期待される Image ID は、バージョンごとにマッピングファイルで管理されます。

マッピングの構造

マッピングファイルには、各バージョンの Image ID、説明、機能リストが記録されます。

| フィールド | 説明 |

|---|---|

| methodVersion | ゲストプログラムのバージョン番号 |

| expectedImageID | ARM64 環境での Image ID |

| expectedImageID_x86_64 | x86_64 環境での Image ID |

| description | バージョンの説明 |

| features | このバージョンで実装された機能リスト |

| current | 現在有効なバージョン番号 |

| deprecated | 非推奨バージョンの一覧 |

バージョン履歴の管理

マッピングファイルはバージョンの履歴を保持します。current フィールドが現在有効なバージョンを指し、deprecated フィールドが過去のバージョンを列挙します。

現行実装では current は 12 で、11 までが deprecated 側へ移っています。

flowchart LR

subgraph マッピングファイル

V8["v8<br/>(deprecated)"]

V9["v9<br/>(deprecated)"]

V10["v10<br/>(deprecated)"]

V11["v11<br/>(deprecated)"]

V12["v12<br/>(current)"]

end

V12 --> ARM["ARM64 Image ID"]

V12 --> X86["x86_64 Image ID"]

Image ID の解決

検証時に使用する期待 Image ID は、methodVersion を明示するかどうかで挙動が分かれます。現行の検証実行フローでは、正規化済みのジャーナル から methodVersion を取得して resolveExpectedImageId(methodVersion) を呼びます。public-input.json へのフォールバックは現行実装では使っていません。

flowchart TD

START[Image ID 解決] --> P1{環境変数<br/>EXPECTED_IMAGE_ID<br/>が設定されている?}

P1 -->|Yes| USE1[環境変数の値を使用]

P1 -->|No| P2{methodVersion を<br/>明示している?}

P2 -->|Yes| P3{現行サポート対象の<br/>methodVersion か?}

P3 -->|No| ERR1[エラーで中断]

P3 -->|Yes| LOAD1[その version の<br/>マッピングを読み込み]

LOAD1 --> P4{読み込み成功?}

P4 -->|No| ERR2[エラーで中断]

P4 -->|Yes| P5{WSL 実行環境かつ<br/>expectedImageID_x86_64 が存在?}

P5 -->|Yes| X86A[expectedImageID_x86_64 を使用]

P5 -->|No| ARMA[expectedImageID を使用]

P2 -->|No| LOAD2[current の<br/>マッピングを読み込み]

LOAD2 --> P6{読み込み成功?}

P6 -->|No| DEF[既定値へフォールバック]

P6 -->|Yes| P7{WSL 実行環境かつ<br/>expectedImageID_x86_64 が存在?}

P7 -->|Yes| X86B[expectedImageID_x86_64 を使用]

P7 -->|No| ARMB[expectedImageID を使用]

要点は次のとおりです。

- 現行の

/api/verification/run系フローでは、current journal contract のmethodVersionを使って解決するため、未対応バージョンやマッピング読み込み失敗はfail-closed(安全側に倒して失敗)でエラーになります。 - 組み込みの既定値へのフォールバックは、

methodVersionを明示しない汎用呼び出しでのみ使われます。 - 環境変数

EXPECTED_IMAGE_IDは、どちらの経路でも最優先の明示オーバーライドです。

検証パイプラインにおける役割

Image ID は 4 段階検証モデルの STARK 検証段階で使用されます。

Image ID 関連チェック

現行実装では、STARK 検証段階で次の 2 つの必須チェックが Image ID に関与します。

stark_image_id_match:receipt.jsonラッパーのimage_idと期待値を照合するstark_receipt_verify: 同じ期待 Image ID を使ってReceipt::verify(expectedImageID)を実行する

詳細は 検証サービス を参照してください。

Image ID が不一致の場合、以下のいずれかの状況を意味します:

| 原因 | 対処 |

|---|---|

| マッピングが古い | ゲストの再ビルド後にマッピングを更新する |

| 異なるゲストで証明が生成された | レシートの出所を調査する |

| アーキテクチャの不一致 | 正しいアーキテクチャの Image ID で照合する |

Image ID の更新手順

ゲストプログラムを変更した場合、Image ID を更新する必要があります。

- ゲストコードを変更する

- zkVM ゲストをビルドし、新しい Image ID を取得する

public/imageId-mapping.jsonを更新する(必要に応じてexpectedImageID_x86_64も更新)- フォールバック定数を持つ関連コードも更新する(現行実装では

src/lib/verification/expected-image-id.ts) - プローバーイメージとマッピングを同時にデプロイする

更新の同期要件

Image ID の更新は、プローバーイメージのデプロイとマッピングファイルの更新を同時に行う必要があります。

| 不整合の状態 | 結果 |

|---|---|

| 新プローバー + 旧マッピング | 検証時に Image ID 不一致で失敗 |

| 旧プローバー + 新マッピング | 検証時に Image ID 不一致で失敗 |

| 新プローバー + 新マッピング | 正常動作 |

組み込みの既定 Image ID も残っているため、更新手順の step 4 にあるとおり、ゲスト変更時はマッピングと定数を同時に更新してください。

本リポジトリの現行運用では、Image ID 更新時に旧バージョンとの検証互換は維持しません。

- プローバーイメージと

imageId-mapping.jsonは同一リリースで切り替える - 通常の

/api/verification/runフローでは、現行の journal contract のみ受け付ける - 旧成果物は Image ID 照合に進む前に、未対応の journal contract として失敗し得る

セキュリティ上の位置づけ

Image ID は、zkVM の信頼モデルにおける重要な信頼アンカーです。

- Image ID を知っている検証者は、ゲストプログラムのロジックを信頼できる: レシートが有効であれば、そのロジックが正しく実行されたことが保証される

- Image ID の管理が破綻すると、検証の信頼性が失われる: 攻撃者が独自のゲストプログラムで有効なレシートを生成し、その Image ID がマッピングに混入すると、不正な集計が「検証済み」として受理される

マッピングファイルは公開リポジトリにコミットされ、変更履歴が追跡可能です。AWS 構成では、イメージ署名検証と組み合わせることで、承認されたプローバーイメージのみが使用されることを保証しています。イメージ署名の詳細は イメージ署名 を参照してください。

検証パイプライン

投票の完全性を 4 段階で検証するパイプラインの設計と実装を解説します。

この部に含まれる章

- 設計と実行フロー — 設計原則、パイプライン構造、実行フロー

- 4 段階検証モデル — 検証の全体設計と各段階の保証

- チェック一覧 — 全検証チェック ID とその判定ロジック

- バンドル構造 — 証明バンドルの公開・非公開アーティファクト

- ゲーティングロジック — 「Verified」表示の条件と不変条件

設計と実行フロー

検証パイプラインの設計原則、全体構造、実行フローを解説します。

設計原則

本システムの検証パイプラインは、以下の 3 つの原則に基づいて設計されています。

原則 1: 必要な検証が未実行なら Verified を表示しない

required チェックが not_run(未実行)、pending(依存待ち)、running(実行中)のいずれかにある場合、システムは「Verified」を表示しません。証拠の不在や未解決状態を成功として扱わないという姿勢です。

原則 2: 失敗した検証は即座にブロックする

いずれかの必須チェックが失敗すれば、「Verified」表示は即座にブロックされます。代表的な失敗条件:

excludedSlots > 0(除外されたスロットが存在する)- 整合性証明の失敗

- 公開監査アーティファクトとの不一致

- 第三者 STH 合意の不成立(設定時)

原則 3: チェック評価はサーバー中心、集約はサーバーとクライアントの双方で実施

- 22 個の検証チェックは主にサーバー側(

GET /api/verify)で評価されます。 - Cast-as-Intended のみクライアントがローカルで上書き評価します(サーバーは

not_runを返却)。 - Recorded-as-Cast は cast-time 証跡(

voteReceiptとuserVote.proof)を前提とします。store から再構成できない場合でも/api/verifyは200を返し、関連チェックをnot_runにして全体判定をmissing_evidence側へ fail-closed に倒します。 - STARK 検証は専用サービス(

POST /api/verification/run)で実行され、GET /api/verifyがその結果を読み取ります。 verificationSteps[].statusは required チェック群を基準に導出されますが、現行実装ではjournalやuserVote.proof.treeSizeが不在の場合にverificationSteps[].statusをnot_runに上書きするガード条件もあります。deriveVerificationSummaryはサーバー側の/api/verifyとクライアント側の/verifyの両方で使われます。サーバーはverificationStatusを fail-closed(安全側に倒す方向)に補正し、unsupported な verifier status でもverificationSteps/verificationChecksを含む200応答を返します。クライアントは summary に加えて STARK timeout や transport failure も最終失敗表示に反映します。UI 側の補助分岐については ゲーティングロジック を参照してください。

検証パイプラインの全体構造

1. 段階の依存関係

- Stage 1 — Cast-as-Intended

- Stage 2 — Recorded-as-Cast

- Stage 3 — Counted-as-Recorded

- Stage 4 — STARK Verification

- 結果表示

2. 実行責務(どこで評価・検証されるか)

flowchart TD

subgraph SERVER["サーバー側"]

VFY["GET /api/verify<br/>Stage 2-4 の 22 チェックを組み立て<br/>cast-time 証跡不在時は fail-closed<br/>(Cast は not_run)"]

RUN["POST /api/verification/run<br/>bundle 参照と expected Image ID で<br/>Stage 4 を検証"]

end

subgraph CLIENT["クライアント(UI)"]

UI["Cast のローカル再評価<br/>STARK 解決後に step 表示を開始<br/>summary と明示的 proof failure を反映"]

end

VFY --> UI

RUN --> UI

検証の実行フロー

検証導線では通常 /result から /verify へ進みます。

/resultは継続用のクライアント状態(verificationRequestedAtと正準な finalization snapshot)を保存し、必要ならPOST /api/verification/runを先行起動します/verifyはその継続状態がある場合に検証シーケンスを続行します。STARK が未開始ならシーケンス内で起動できます- 継続状態がなく STARK が

not_runのまま直接/verifyへアクセスした場合は、自動続行せずブロックします /verifyの UI シーケンスは、step を順に見せる前に STARK が terminal status に到達するまでポーリングします。timeout や transport failure は STARK failure として扱われます

sequenceDiagram

participant U as ブラウザ

participant R as /result

participant V as /verify

participant A as API サーバー

participant VS as 検証サービス

U->>R: 「検証へ進む」をクリック

R->>A: POST /api/verification/run(必要時)

A->>VS: bundle 参照 + expected Image ID

VS->>VS: Receipt::verify(imageId)

VS-->>A: 検証レポート保存

R-->>V: /verify へ遷移

loop STARK 完了までポーリング

V->>A: GET /api/verify

A-->>V: 検証ペイロード<br/>(ステップ, チェック, 証明材料)

end

Note over V: 継続には verificationRequestedAt と finalization snapshot が必要<br/>not_run の direct access はブロック<br/>step 表示は STARK 解決後に開始

4 段階の概要

| 段階 | 名称 | 証明する内容 | 検証の実行場所 |

|---|---|---|---|

| Stage 1 | Cast-as-Intended | 投票者の意図通りにコミットメントが生成された | クライアント(/verify 画面でローカル再計算) |

| Stage 2 | Recorded-as-Cast | コミットメントが追記専用掲示板に正しく記録された | サーバー(GET /api/verify) |

| Stage 3 | Counted-as-Recorded | 記録された全投票が正しく集計に含まれた | サーバー(GET /api/verify) |

| Stage 4 | STARK Verification | zkVM の実行が正しく行われたことの暗号学的証明 | サーバー(POST /api/verification/run) |

クライアントは Cast-as-Intended のローカル再計算、STARK 解決後の step 表示、最終表示の整形を担当します。サーバー側の fail-closed 補正と cast-time 証跡不在時の動作は上記「原則 3」を参照してください。

各ステージの verificationSteps[].status は、そのステージで required 扱いになるチェック群から導出されます。たとえば Recorded-as-Cast では、STH ソースが設定されている場合に限り recorded_sth_third_party も必須条件に昇格します。ただし、一部のステージにはデータ不在時のガード条件があります(上記「原則 3」参照)。特に Recorded-as-Cast は userVote.proof.treeSize がなければ not_run になり、Counted-as-Recorded は journal がなければ failed でない限り not_run に補正されます。

各段階の詳細は 4 段階検証モデル を参照してください。

検証チェック数

パイプライン全体で 22 個の検証チェックが定義されており、各チェックには一意の ID が割り当てられています。チェック ID の単一ソースは src/lib/verification/verification-checks.ts です。

| 段階 | チェック数 |

|---|---|

| Cast-as-Intended | 4 |

| Recorded-as-Cast | 6 |

| Counted-as-Recorded | 10 |

| STARK Verification | 2 |

| 合計 | 22 |

Counted-as-Recorded の required チェックには counted_election_manifest_consistent と counted_close_statement_consistent も含まれます。これにより、公開された election-manifest.json / close-statement.json と検証対象データの整合も stage success の条件に含まれます。

チェックの詳細は チェック一覧 を参照してください。

4 段階検証モデル

E2E 検証可能投票の 4 段階検証モデルの設計と各段階の保証を解説します。

段階間の依存関係

概念モデルとしては 4 段階を順に評価しますが、実行場所は段階ごとに異なります(Stage 1 はクライアント、Stage 2-4 はサーバー中心)。実行責務の詳細は 設計と実行フロー を参照してください。

flowchart LR

subgraph "証拠の生成"

V["投票時<br/>投票レシート発行"]

F["集計時<br/>zkVM 実行"]

end

subgraph "4 段階検証"

S1["Stage 1<br/>Cast-as-Intended"]

S2["Stage 2<br/>Recorded-as-Cast"]

S3["Stage 3<br/>Counted-as-Recorded"]

S4["Stage 4<br/>STARK Verification"]

end

V --> S1

V --> S2

F --> S3

F --> S4

S1 ~~~ S2

S2 ~~~ S3

S3 ~~~ S4

Stage 1: Cast-as-Intended

目的

投票者が意図した選択肢のコミットメントが、サーバーから返却された投票レシートと一致することを確認します。これにより、サーバーが投票者の選択を差し替える攻撃を検出します。

検証する内容

/verify 画面のクライアントコードがローカルに保持された 3 つの値(選挙 ID、選択肢、乱数)からコミットメントを再計算し、投票レシートのコミットメント値と照合します。

flowchart LR

subgraph "投票時に確定したデータ"

EID[選挙 ID]

CH[選択肢]

RND[乱数]

end

subgraph "再計算"

HASH["SHA-256<br/>(ドメインタグ || 選挙ID || 選択肢 || 乱数)"]

end

subgraph "照合"

CMP{"一致?"}

REC[投票レシートの<br/>コミットメント]

end

EID --> HASH

CH --> HASH

RND --> HASH

HASH --> CMP

REC --> CMP

必要な証拠

| 証拠 | 保管場所 | 説明 |

|---|---|---|

| 選挙 ID | クライアントセッション(localStorage.starkBallotSession) | セッション作成時に確定した UUID |

| 選択肢 | クライアントセッション(localStorage.starkBallotSession) | 投票者が選択した値(A〜E) |

| 乱数 | クライアントセッション(localStorage.starkBallotSession) | 投票時にクライアントが生成した 32 バイト乱数 |

| 投票レシート | GET /api/verify 応答(voteReceipt) | 投票レシート(commitment, voteId, bulletinIndex, bulletinRootAtCast) |

voteReceipt は cast-time 証跡を store から再構成できた場合にだけ /api/verify から返ります。再構成できない場合の動作は 設計原則 3 を参照してください。

失敗モード

| 症状 | 原因 | 深刻度 |

|---|---|---|

| ローカル証拠の欠落 | localStorage 消去や別端末アクセスで投票時データを復元できない | 検証不能 |

| 投票レシート証跡の欠落 | store から cast-time 証跡を再構成できず、voteReceipt が省略 | 検証不能 |

| コミットメント不一致 | 投票時データと投票レシートの不整合、またはエンコーディングの不整合 | 重大 |

| 選択肢の範囲外 | 不正な入力(A〜E の範囲外) | 重大 |

| 乱数フォーマット不正 | 32 バイト hex でない | 重大 |

限界

Cast-as-Intended は以下の証拠に依存します:

- クライアント保持のローカル証拠(選挙 ID、選択肢、乱数)

/api/verifyが返す投票レシート(voteReceipt)

いずれかが欠ける場合、この段階は not_run になり最終判定は Verified になりません。

Stage 2: Recorded-as-Cast

目的

投票者のコミットメントが、追記専用の掲示板(CT Merkle ツリー)に正しく記録されていることを確認します。さらに、掲示板が追記専用性を維持していること(過去のエントリが削除・改変されていないこと)を検証します。

検証する内容

この段階には 3 系統の検証があります。UI ステップとの対応関係は ゲーティングロジック を参照してください。

flowchart TB

subgraph "2a: 包含証明"

IP["包含証明の検証<br/>自分のコミットメントが<br/>ツリーに存在するか"]

end

subgraph "2b: 整合性証明"

CP["整合性証明の検証<br/>投票時のルートから<br/>最終ルートへの追記専用性"]

end

subgraph "2c: 第三者 STH 検証"

STH["STH 合意の検証<br/>独立したソース間で<br/>ツリー状態が一致するか"]

end

IP --> RESULT{"Recorded 系の証拠を総合評価"}

CP --> RESULT

STH --> RESULT

2a: 包含証明(Inclusion Proof)

RFC 6962 の PATH 関数に基づく CT スタイルの Merkle 包含証明を検証し、投票者のコミットメントが掲示板のツリーに含まれていることを確認します。検証者はリーフハッシュと監査パスからルートハッシュを再計算し、期待されるルートと照合します。

2b: 整合性証明(Consistency Proof)

投票時点のツリー状態(ルートとサイズ)から、最終的なツリー状態への遷移が追記のみで行われたことを検証します。RFC 6962 の SUBPROOF アルゴリズムに基づく整合性証明により、サーバーが過去のエントリを密かに削除したり順序を変更したりするスプリットビュー攻撃を検出します。

2c: 第三者 STH 検証(オプション)

複数の独立した STH(Signed Tree Head)ソースに問い合わせ、合意が成立しているかを確認します。これにより、サーバーが検証者ごとに異なるツリー状態を提示するスプリットビュー攻撃を検出します。照合条件の詳細は チェック一覧 を参照してください。

必要な証拠

| 証拠 | 取得元 | 説明 |

|---|---|---|

| 包含証明の検証結果 | /api/verify | サーバー側で RFC 6962 包含証明を評価したチェック結果 |

| 整合性証明の検証結果 | /api/verify | サーバー側で RFC 6962 整合性証明を評価したチェック結果 |

| 投票時のルートハッシュ | 投票レシート | 投票受理時のツリールート |

| 投票時のツリーサイズ(oldSize) | /api/verify の userVote.proof.treeSize | 整合性証明の oldSize |

| 最終ルートハッシュ/最終ツリーサイズ | /api/verify | 集計時の最終状態 |

| 独立検証用の包含証明材料(任意) | /api/bulletin/:voteId/proof | クライアント外で個別に包含証明を再検証するための材料 |

| 補助 tooling の整合性証明材料(任意) | /api/bulletin/consistency-proof | secondary tooling 向け。現行 /verify ページの verdict authority には含めない |

| STH スナップショット | 設定済み STH ソース(例: /api/sth + 外部) | 第三者ソースの照合対象(必須は digest、root/treeSize は返却時のみ) |

userVote.proof.treeSize は整合性証明における authoritative な oldSize であり、現行実装では voteReceipt.bulletinIndex + 1 との一致も要求します。cast-time 証跡が欠ける場合の fail-closed 動作は 設計原則 3 を参照してください。

失敗モード

| 症状 | 原因 | 深刻度 |

|---|---|---|

| 包含証明の検証失敗 | ツリーサイズ/インデックスの不一致、掲示板のリセット | 重大 |

| 整合性証明の検証失敗 | 追記専用性の違反(スプリットビュー攻撃の可能性) | 重大 |

| cast-time 証跡の欠落 | store から voteReceipt / userVote.proof を再構成できず、Recorded が未実行 | 検証不能 |

| 第三者 STH 合意の不成立 | サーバーが検証者ごとに異なるツリーを提示 | 重大(有効時) |

| ルートが履歴に存在しない | ルート履歴の不整合 | 重大 |

Stage 3: Counted-as-Recorded

目的

掲示板に記録された全投票が、zkVM の集計処理に正しく含まれたことを確認します。投票の除外、欠落、重複がないことに加え、公開された claimed tally(表示用集計値)が zkVM の verifiedTally と一致することを検証し、集計結果の完全性と整合性を保証します。

検証する内容

この段階では 10 個の required チェックが全て success であることを要求します。

verificationSteps[].status も最終サマリーも、Counted stage で required 扱いになるチェック群全体から導出されます。journal がない場合は guard により stage 自体が not_run になります。UI ステップとの対応や journal 省略時の詳細は ゲーティングロジック を参照してください。

flowchart TD

subgraph PUBLIC["public 系 required (6)"]

P["counted_input_sanity<br/>counted_unique_indices<br/>counted_unique_<br/>commitments<br/>counted_election_<br/>manifest_consistent<br/>counted_close_<br/>statement_consistent<br/>counted_input_<br/>commitment_match"]

end

subgraph ZK["zk 系 required (4)"]

Z["counted_tally_consistent<br/>counted_missing_<br/>indices_zero<br/>counted_expected_<br/>vs_tree_size<br/>counted_my_vote_<br/>included"]

end

RESULT{"10 required 全て success?"}

PASS["Counted: success"]

FAIL["Verified をブロック"]

P --> RESULT

Z --> RESULT

RESULT -->|Yes| PASS

RESULT -->|No| FAIL

必要な証拠

| 証拠 | 取得元 | 説明 |

|---|---|---|

| zkVM ジャーナル(詳細) | /api/verify?includeJournal=1 | 集計結果、除外情報、inputCommitment、includedBitmapRoot、seenBitmapRoot などの詳細 |

| 集計サマリー(通常応答) | /api/verify | missingSlots / invalidPresentedSlots / rejectedRecords / excludedSlots / totalExpected / treeSize などの上位値 |

| 公開入力サマリー | サーバー内部評価用 | public-input.json 相当から組み立てた、秘密データを含まない入力要約 |

| 選挙マニフェスト | 公開 bundle (election-manifest.json) | electionId と electionConfigHash を束縛する公開 artifact |

| 締め処理ステートメント | 公開 bundle (close-statement.json) | logId / treeSize / bulletinRoot / timestamp / sthDigest を束縛する公開 artifact |

| ビットマップ証明材料 | /api/bitmap-proof | kind=included と kind=seen を使い分け、自分のインデックスが counted されたことや prover に提示されたかを説明する材料 |

| ビットマップルート | ジャーナル | zkVM ゲストが計算した includedBitmapRoot と seenBitmapRoot |

公開入力サマリーはサーバー内部表現であり、レスポンスにそのまま含まれません。inputCommitment が束縛するのは public-input.json の部分集合です。Counted stage では journal と slot-based なフィールド(excludedSlots 等)を正とし、missingIndices / invalidIndices / excludedCount は互換用としてのみ扱います。解決順序の詳細は チェック一覧 を参照してください。各チェックの判定ロジックは チェック一覧 を参照してください。

重要な判定: 除外数(excludedSlots / excludedCount)

excludedSlots は fail-closed(安全側に倒す)判定に使う除外数です。excludedCount は互換性のために残る旧名称で、同じ値を指します。

excludedSlots == 0: 除外なし(正常)excludedSlots > 0: 掲示板スロットの未提示または計上失敗(即座に検証失敗)

counted_missing_indices_zero が除外数を解決し、0 でなければ failed になります。解決の優先順序は チェック一覧 を参照してください。除外数が残っている限り、最終判定は「Verified」を表示しません。

失敗モード

| 症状 | 原因 | 深刻度 |

|---|---|---|

excludedSlots > 0 | 欠落スロットまたは計上失敗スロットが存在する | 重大(即座にブロック) |

| 欠落スロット / invalid presented slot | 一部の bulletin slot が prover に提示されなかった、または提示後に計上されなかった | 重大 |

| 公開集計値の不一致 | 公開表示された tally.counts が zkVM の verifiedTally と一致しない | 重大(claimed tally 改ざんシナリオ S2/S4 で発火) |

| 集計合計の不一致 | verifiedTally の合計が validVotes または tally.totalVotes と一致しない | 重大 |

| 選挙マニフェスト不整合 | electionId または electionConfigHash が verification inputs と一致しない | 重大(必須チェック失敗) |

| 締め処理ステートメント不整合 | logId / timestamp / sthDigest / bulletinRoot / treeSize が一致しない | 重大(必須チェック失敗) |

| 入力コミットメント不一致 | 公開入力のうち inputCommitment 対象フィールドと zkVM 実行で使用された入力が異なる | 重大 |

| 自票のビットマップ証明が失敗または欠落 | bit が 0、proof source 不可、またはルート不一致 | 重大(required check が failed/not_run) |

| ツリーサイズの不一致 | totalExpected と treeSize が異なる(暗黙の除外、または close/input side の不整合を示す) | 重大(必須チェック失敗) |

Stage 4: STARK Verification

目的

zkVM の実行が正しく行われたことを STARK 証明(レシート)の暗号学的検証により確認します。レシートの検証に成功すれば、ジャーナルの内容(集計結果、除外情報、入力コミットメント等)がゲストプログラムの正しい実行の結果であることが保証されます。

検証する内容

flowchart LR

subgraph "入力"

RCP[レシート<br/>Seal + Journal]

EID[期待 Image ID]

end

subgraph "Rust 検証サービス"

VF["Receipt::verify(imageId)"]

end

subgraph "結果"

OK["success<br/>暗号学的に検証済み"]

NG["failed<br/>証明が無効"]

DM["dev_mode<br/>フェイクレシート"]

end

RCP --> VF

EID --> VF

VF --> OK

VF --> NG

VF --> DM

検証の 2 段階

STARK Verification では 2 つのチェックを実行します。

Image ID 照合: 検証サービスの report が利用できる場合、receipt_image_id が期待 Image ID と一致することを確認します。加えてホストが主張する Image ID(imageId)や comparison-only の journal.imageId とも矛盾しないことを検証します(解決順の詳細は チェック一覧 の stark_image_id_match を参照)。Image ID はゲストプログラムから導出される暗号的識別子であり、プログラムの改変やホスト主張値の食い違いを検出します。

レシート検証: RISC Zero の Receipt::verify() を呼び出し、Seal(STARK 証明)がジャーナルと Image ID に対して暗号学的に正当であることを検証します。この検証は計算量が多いため、サーバー側の Rust 検証サービスで実行されます。

必要な証拠

| 証拠 | 取得元 | 説明 |

|---|---|---|

| レシート(Seal + Journal) | 証明バンドル | zkVM ホストが生成した STARK 証明 |

| 期待 Image ID | サーバー側で解決 | ゲストプログラムの暗号的識別子(解決順は チェック一覧 参照) |

| ホスト主張値と比較用メタデータ | 検証コンテキストと report | imageId, journal.imageId, verificationReport.receipt_image_id を相互照合し、主張の食い違いを検出 |

開発モードの検出

RISC0_DEV_MODE=1 で生成されたレシートは InnerReceipt::Fake 型であり、暗号学的な保証を持ちません。検証サービスはこれを dev_mode ステータスとして報告します。チェック評価では、設定に応じて dev_mode は success または not_run に正規化されます(既定では not_run 側)。

失敗モード

| 症状 | 原因 | 深刻度 |

|---|---|---|

| Image ID 不一致 | マッピングが古い、ホスト主張値が誤っている、またはプローバーイメージが異なる | 重大 |

| レシート検証失敗 | 証明が暗号学的に無効 | 重大 |

| 開発モード検出 | フェイクレシートが混入 | 重大 |

UI ステップと最終判定

UI ステップの対応チェック、集約ルール、最終 verdict の決定方法は ゲーティングロジック を参照してください。

チェック一覧

全検証チェック ID の定義、判定ロジック、失敗時の影響を一覧で解説します。

各チェックは一意の ID を持ち、success / failed / not_run / running / pending のステータスで管理されます。not_run のチェックが残っている場合、「Verified」は表示されません。

チェックの属性

各チェックには以下の属性が定義されています。

| 属性 | 説明 |

|---|---|

| ID | チェックの一意な識別子(スネークケース) |

| カテゴリ | 所属する検証段階 |

| 証拠種別 | チェックに使用するデータの出所 |

| 重要度 | required(必須)または optional(任意) |

| 派生元 | 他のチェックから結果を導出する場合のソースチェック ID |

証拠種別

| 種別 | 説明 |

|---|---|

local | 投票者の端末に保持されたユーザー固有データ(localStorage の投票意図など) |

public | 掲示板や capability 保護 API から取得する、秘密データを含まない検証用データ |

zk | zkVM が束縛した公開証拠(ジャーナル、receipt 検証結果、bitmap root に基づく証明など) |

重要度

| 重要度 | 説明 |

|---|---|

required | 「Verified」表示に必須。失敗すれば即座にブロック |

optional | 補助的な検証。通常は単独で失敗扱いにしないが、実行時条件により blocking に昇格する場合がある |

代表例は recorded_sth_third_party です。

注意: verificationChecks と UI 表示用の verificationSteps は 1 対 1 ではありません。対応関係は ゲーティングロジック を参照してください。

Cast-as-Intended(4 チェック)

投票者の意図通りにコミットメントが生成されたかを検証するチェック群です。

このカテゴリはクライアントが voteReceipt(/api/verify 応答)とローカル投票意図(electionId/myVote/myRand)を使って評価します。

| ID | 説明 | 証拠種別 | 重要度 |

|---|---|---|---|

cast_receipt_present | 投票レシートが存在し、voteId とコミットメントを含む | local | required |

cast_choice_range | 選択肢が有効範囲内(A〜E) | local | required |

cast_random_format | 乱数が 32 バイトの 16 進数文字列 | local | required |

cast_commitment_match | 投票時データから再計算したコミットメントが投票レシートと一致 | local | required |

判定ロジックの詳細

cast_receipt_present